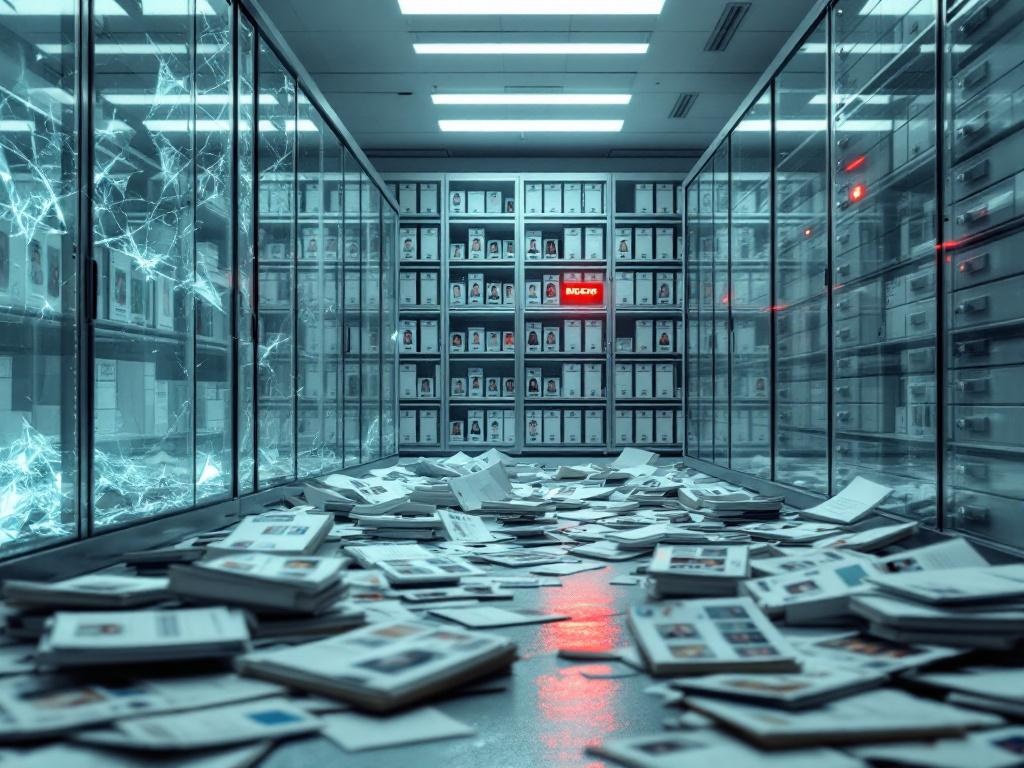

Das KI-Startup Mercor, das Trainingsdaten für große Sprachmodelle an Unternehmen wie OpenAI, Anthropic und Meta lieferte, steckt in der schwersten Krise seiner Unternehmensgeschichte. Die Hackergruppe Lapsus$ beanspruchte den Diebstahl von vier Terabyte Daten — darunter aufgezeichnete Bewerbungsgespräche, biometrische Gesichtsdaten und Quellcode. Was folgte: mindestens sieben Sammelklagen, ein Vertragsabbruch durch Meta und eine Grundsatzdebatte darüber, wie weit KI-Unternehmen bei der Datenbeschaffung gehen dürfen, bevor Regulierung und Öffentlichkeit sie einholen. Mercor ist kein Einzelfall — aber ein besonders plastisches Symptom einer Branche, die Regeln als nachrangig betrachtet.

- Nach einem vier Terabyte großen Daten-Diebstahl durch die Hackergruppe Lapsus$ sieht sich das KI-Startup Mercor mit sieben Sammelklagen konfrontiert.

- Als direkte Reaktion hat der Großkunde Meta alle Verträge eingefroren, was das gesamte Geschäftsmodell des Datenvermittlers existentiell bedroht.

- Der Fall ist ein akutes Warnsignal für europäische Unternehmen, die angesichts strenger Vorgaben des EU AI Acts für externe KI-Trainingsdaten mitverantwortlich sind.

Der Fall wirft drei Fragen auf, die über Mercor hinausreichen: Welche Daten dürfen KI-Firmen von Auftragnehmern überhaupt erheben? Wer haftet, wenn diese Daten abfließen? Und was passiert mit einem Geschäftsmodell, das auf dem Vertrauen zehntausender Freelancer aufgebaut ist, sobald dieses Vertrauen öffentlich zerbricht? Die Antworten auf alle drei Fragen fallen für Mercor derzeit unangenehm aus.

Lapsus$, LiteLLM und vier Terabyte: Was tatsächlich passiert ist

Lapsus$ ist kein unbekannter Akteur. Die Gruppe hat in der Vergangenheit Microsoft, NVIDIA und Samsung ins Visier genommen — und tritt nun gegen ein KI-Startup an, das strukturell genau das speichert, was Angreifer begehren: persönliche Identifikationsdaten, biometrische Muster, Aufnahmen aus Bewerbungsgesprächen, Hintergrundüberprüfungen. Mercor bestätigte, Ziel eines Cyberangriffs gewesen zu sein, nachdem Lapsus$ behauptet hatte, fast ein Terabyte Quellcode und drei Terabyte Video- und Verifikationsdaten gestohlen und zum Verkauf angeboten zu haben.

Der genaue Einstiegspunkt war laut Recherchen ein Supply-Chain-Angriff auf das Open-Source-Tool LiteLLM, das für eine kurze Zeitspanne infiziert war und Anmeldedaten abgreifen konnte. Das ist aus Sicherheitsperspektive eine klassische, aber erschreckend effektive Angriffsmethode: Nicht das Ziel selbst wird kompromittiert, sondern ein Zulieferer, auf den das Ziel vertraut. Für Mercor bedeutet das: Die Schwachstelle lag zumindest teilweise außerhalb des eigenen Perimeters — was die Haftungsfrage juristisch komplizierter, die öffentliche Wahrnehmung aber nicht milder macht.

Bemerkenswert ist auch, wer in den Kontext dieses Vorfalls geraten ist: Das Compliance-Startup Delve, das LiteLLM bei Sicherheitszertifizierungen unterstützt haben soll, steht im Verdacht, Zertifikate manipuliert zu haben, und wurde in der Folge von Y Combinator getrennt. Das ist ein Kollateralschaden, der zeigt, wie vernetzt und damit verwundbar das Ökosystem der KI-Zulieferer ist.

Die Klagen: Biometrie, Überwachungssoftware und geteilte Hintergrundchecks

Sieben Sammelklagen gegen ein Unternehmen sind keine Bagatelle. Was die Klagen inhaltlich vorwerfen, ist noch gravierender als die bloße Zahl suggeriert. Eine in Kalifornien eingereichte Klage behauptet konkret, Mercor habe aufgezeichnete Bewerbungsgespräche, biometrische Gesichtsdaten, Screenshots von Arbeitscomputern der Auftragnehmer sowie weitere vertrauliche Materialien offengelegt. Das ist keine technische Datenpanne im engeren Sinne — das ist der Vorwurf einer systematisch fehlerhaften Datenstrategie.

Hinzu kommen Vorwürfe, die unabhängig vom Hack bestehen:

- Mercor soll eine Überwachungssoftware namens „Insightful" eingesetzt haben, die Bildschirmfotos auf Arbeitsrechnern der Auftragnehmer aufzeichnete.

- Hintergrundüberprüfungsdaten sollen mit Partnern geteilt worden sein — ohne ausreichende Rechtsgrundlage, so der Vorwurf der Kläger.

- Auftragnehmer sollen aufgefordert worden sein, echte Unternehmensdaten für KI-Trainingsaufgaben zu verwenden, auch wenn diese Daten ihnen rechtlich nicht gehörten.

- Mercor soll versucht haben, Arbeitsmaterialien von LinkedIn-Nutzern zu kaufen, darunter Dokumente, an denen die Verkäufer keine vollständigen Rechte hielten.

Mercor bestreitet die Vorwürfe und erklärte in einem Statement, man „bestreite die spekulativen Behauptungen entschieden" und arbeite mit externen Forensik-Experten sowie betroffenen Stakeholdern zusammen. Das ist eine juristisch erwartbare Reaktion — inhaltlich beantwortet sie die strukturellen Fragen rund um das Geschäftsmodell aber nicht.

Shayne Longpre, MIT-Doktorand und KI-Forscher, brachte den übergeordneten Mechanismus gegenüber dem Wall Street Journal auf den Punkt: Unternehmen wie Mercor, die Zehntausende Auftragnehmer beschäftigen, suchen zunehmend nach „Spezialquellen" — Personen mit tiefem Fachwissen in Bereichen wie Finanzen, Medizin, Recht oder Naturwissenschaften. Der Druck, Wettbewerber in der KI-Entwicklung zu schlagen, erzeuge einen Anreiz, Regeln erst nachträglich zu klären und kurzfristig so viel Marktanteil wie möglich zu sichern. Das ist eine ernüchternde, aber akkurate Beschreibung der Branchenlogik.

Metas Schritt und seine Signalwirkung für die KI-Lieferkette

Als Meta seine Verträge mit Mercor nach Bekanntwerden des Datenlecks einfror, war das mehr als ein einzelner Geschäftsentscheid. Meta ist einer der größten Abnehmer von KI-Trainingsdaten weltweit und damit ein Referenzpunkt für andere Unternehmen. Berichten zufolge erwogen weitere KI-Firmen, die Zusammenarbeit mit Mercor zu beenden — ein Dominoeffekt, der das Kerngeschäftsmodell des Startups direkt bedroht.

Was dieser Schritt für die Branche bedeutet: Datenvermittler wie Mercor befinden sich in einer strukturellen Zwickmühle. Ihr Wert liegt in der Qualität und Exklusivität der Daten, die sie beschaffen können. Je spezialisierter die Quellen, desto sensibler die Daten — und desto höher das Risiko bei einem Abfluss. Wer gleichzeitig biometrische Daten, Bewerbungsaufzeichnungen und Gerätescreens von Zehntausenden Auftragnehmern aggregiert, schafft ein Angriffsziel mit außerordentlich hohem Schadenspotenzial.

Für Unternehmen, die solche Dienstleister nutzen, stellt sich jetzt eine Frage, die bislang zu wenig gestellt wurde: Welche Due-Diligence-Anforderungen gelten für KI-Datenzulieferer? Wer prüft, ob ein Anbieter die Daten seiner Auftragnehmer rechtskonform erhebt, speichert und schützt? Meta hat diese Frage mit dem Vertragsabbruch implizit beantwortet — und andere Unternehmen unter Druck gesetzt, nachzuziehen.

Was dagegen spricht: Mercors Position ist nicht unhaltbar

Fairerweise lässt sich argumentieren, dass Mercor in einer Reihe von Punkten auch Opfer ist — eines hochprofessionellen externen Angriffs und eines Ökosystems, in dem die rechtlichen Anforderungen an KI-Trainingsdaten bis heute nicht eindeutig kodifiziert sind. Die Lapsus$-Gruppe ist keine Script-Kiddie-Operation, sondern eine dokumentiert gefährliche Akteurgruppe mit nachgewiesener Kompetenz. Dass sie über eine Lieferkettenschwachstelle eindringen konnte, ist ein Versagen im System, nicht ausschließlich bei Mercor.

Hinzu kommt: Überwachungssoftware wie „Insightful" ist im Gig-Economy-Kontext keine Seltenheit. Viele Plattformen setzen Tracking-Tools ein, um die Leistung von Remote-Auftragnehmern zu verifizieren — teils mit Zustimmung der Nutzer in den Allgemeinen Geschäftsbedingungen. Ob Mercor hier transparent kommuniziert hat oder nicht, wird vor Gericht zu klären sein. Die pauschale Empörung über Monitoring-Software greift zu kurz, solange AGBs und Einwilligungsprozesse nicht konkret bewertet wurden.

Dennoch: Die Häufung der Vorwürfe — Biometrie, Gerätescreening, Weitergabe von Hintergrundchecks, Nutzung fremder Unternehmensdaten — deutet auf ein strukturelles Muster hin, nicht auf Einzelfehler. Und das ist der eigentliche Kern des Problems.

EU AI Act und DSGVO: Was das für europäische Anwender bedeutet

Der Mercor-Fall ist kein europäisches Thema — noch nicht. Aber er ist ein Frühwarnsignal für alle DACH-Unternehmen, die KI-Trainingsdaten von externen Anbietern beziehen oder solche Dienste nutzen, die auf Freelancer-Daten basieren.

Unter dem EU AI Act, dessen GPAI-Regeln seit August 2025 in Kraft sind, müssen Anbieter von KI-Systemen mit allgemeinem Verwendungszweck nachweisen, dass ihre Trainingsdaten rechtskonform erhoben wurden. Wer als europäisches Unternehmen Trainingsdaten von Anbietern wie Mercor bezieht, trägt eine Mitverantwortung für die Compliance-Kette. Das ist keine theoretische Gefahr — das ist der explizite Text der GPAI-Leitlinien.

Parallel greift die DSGVO: Die Verarbeitung biometrischer Daten unterliegt nach Art. 9 DSGVO einem besonderen Schutzregime. Gesichtsdaten, wie sie Mercor laut Klagen erhoben hat, sind besondere Kategorien personenbezogener Daten — für deren Verarbeitung eine explizite Rechtsgrundlage erforderlich ist. Für europäische Unternehmen, die ähnliche Auftragsverarbeitungsmodelle nutzen, gilt dasselbe. Eine Datenschutz-Folgenabschätzung nach Art. 35 DSGVO wäre in vergleichbaren Konstellationen Pflicht, nicht Kür.

So What? Die strategische Implikation für DACH-Entscheider

Der Mercor-Fall ist kein Warnhinweis, den du als Entscheider ignorieren kannst, weil er weit weg passiert ist. Er beschreibt ein Muster, das sich überall dort wiederholen wird, wo KI-Trainingsdaten aus menschlichen Quellen aggregiert werden — und das ist genau das Modell, auf das die gesamte Branche setzt. Spezialwissen aus Medizin, Recht, Finanzen und Ingenieurwesen ist der nächste Rohstoff im KI-Rennen.

Was das für DACH-Unternehmen konkret heißt: Wer externe KI-Datenprovider einsetzt oder plant einzusetzen, muss deren Compliance-Status aktiv prüfen — nicht vertraglich wegdelegieren. Das umfasst Fragen zur Erhebung biometrischer Daten, zu Monitoring-Praktiken gegenüber Auftragnehmern, zur Weitergabe von Hintergrundüberprüfungen und zur Rechtekette bei genutzten Arbeitsmaterialien. Eine Supply-Chain-Attestierung im KI-Kontext wird zum Standard werden — Mercor zeigt, was passiert, wenn sie fehlt.

Für Unternehmen, die selbst Auftragnehmer für KI-Trainingsaufgaben einsetzen oder vermitteln, empfiehlt sich eine sofortige Überprüfung der eigenen Datenstrategie: Welche Daten werden erhoben? Welche Rechtsgrundlage existiert je Datenkategorie? Wer hat Zugriff? Und — entscheidend — was passiert, wenn diese Daten abfließen? Die Antworten auf diese Fragen sollten existieren, bevor eine Klageschrift eingeht.

Fazit: Das Modell ist nicht kaputt, aber unfertig

Mercor wird diesen Sturm möglicherweise überstehen — rechtlich, finanziell, operativ. Aber die Krise zeigt ein fundamentales Defizit im Datenvermittler-Segment der KI-Industrie: Das Geschäftsmodell lief dem Compliance-Rahmen davon. Vier Terabyte gestohlene Daten, sieben Sammelklagen und ein Vertragsabbruch durch Meta sind keine Zufälle — sie sind das Ergebnis einer Strategie, bei der Datenbeschaffungsgeschwindigkeit Vorrang vor Datenschutzarchitektur hatte.

Die Prognose lautet: Wenn Mercor seine Verträge mit großen KI-Abnehmern nicht zurückgewinnt und die Klagen sich zu substanziellen Vergleichen oder Urteilen verdichten, wird das Unternehmen als Referenzfall in die Regulierungsdebatte eingehen — ähnlich wie Cambridge Analytica für Social-Media-Datenmissbrauch. Wahrscheinlichkeit, dass mindestens eine der sieben Klagen zu einem nennenswerten Vergleich führt: hoch. Der eigentliche Druck kommt nicht von den Klagen selbst, sondern von jedem weiteren KI-Unternehmen, das jetzt seine Mercor-Verträge auf den Prüfstand stellt. Wenn die Kundenbasis wegbricht, sind Bewertungen schnell Makulatur.

❓ Häufig gestellte Fragen

✅ 12 Claims geprüft, davon 8 mehrfach verifiziert

📚 Quellen