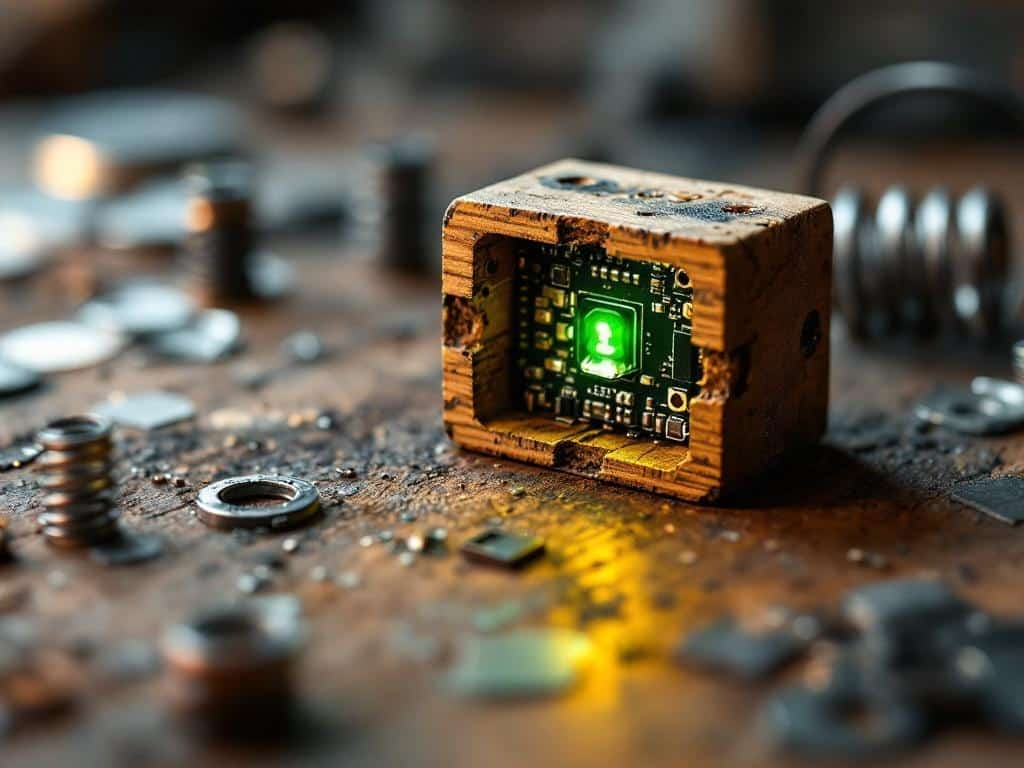

Llama.cpp führt mit Release b8682 das neue Quantisierungsformat Q1_0 ein, das Modellgewichte auf exakt 1 Bit pro Parameter reduziert und somit CPU-Inferenz ohne dedizierte GPU auf ein neues Speicherminimum bringt. Dieses Format, das einen generischen x86-Fallback sowie Unterstützung für weitere Backends bietet, ist breit lauffähig. Für 1-Bit-Formate wird eine Imatrix-Kalibrierung dringend empfohlen, um den Quantisierungsfehler zu minimieren. Obwohl spezifische Perplexity-Benchmarks noch ausstehen, ist der Qualitätsverlust bei so aggressiver Kompression erheblich. Q1_0 ist primär für Edge-Szenarien optimiert, bei denen RAM-Limitierungen oder Offline-Betrieb Vorrang vor der Ausgabequalität haben, wie auf eingebetteten Systemen oder älteren Computern.

- Llama.cpp führt mit dem Release b8682 das Q1_0-Format ein, welches Modellgewichte auf exakt 1 Bit pro Parameter reduziert und den Speicherbedarf massiv senkt.

- Dies ermöglicht CPU-basierte Inferenz auf eingebetteten Systemen und alten PCs ohne GPU, geht jedoch mit einem signifikanten Verlust an Ausgabequalität einher.

- Für Unternehmen bietet die rein lokale Verarbeitung Vorteile bei der DSGVO-Konformität, während die Laufzeitumgebung vorerst von strengen AI-Act-Regeln verschont bleibt.

Der Arbeitsablauf für Q1_0 Modelle ähnelt dem etablierten Llama.cpp-Muster, beginnend mit der Konvertierung eines Hugging-Face-Modells ins GGUF-Format und anschließender Quantisierung. Für den Release b8682 sind vorgefertigte Binaries für verschiedene Betriebssysteme und Architekturen verfügbar, darunter macOS, Linux und Windows. Für Unternehmen, die Llama.cpp im EU-Kontext nutzen und personenbezogene Daten lokal verarbeiten, bietet die vollständig lokale Ausführung eine Lösung für DSGVO-Konformität bei Drittlandtransfers. Zudem wird darauf hingewiesen, dass reine Inferenz-Runtimes wie Llama.cpp derzeit nicht als Hochrisiko-KI nach dem AI Act klassifiziert sind, obwohl bestimmte Anwendungsfälle zukünftig unter diese Kategorien fallen könnten.

❓ Häufig gestellte Fragen

📚 Quellen

- ggml-org/Llama.cpp: Release b8682 — Q1_0 1-Bit-Quantisierung (CPU)

- Qwen Docs: Llama.cpp Quantization Workflow