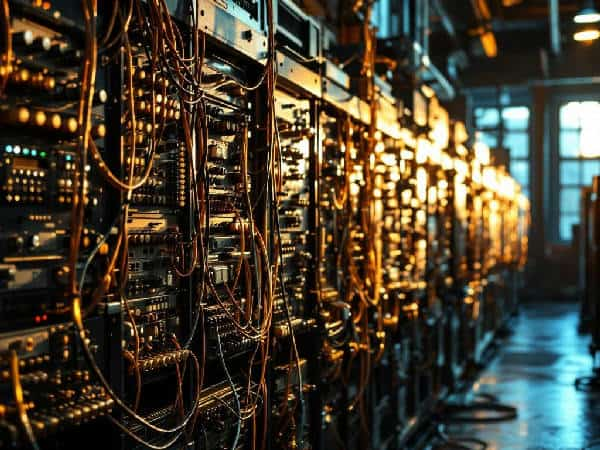

Meta setzt im Rahmen seines Capacity Efficiency Programms auf ein System autonomer KI-Agenten, um die Performance seiner globalen Server-Infrastruktur im Hyperscale-Betrieb zu optimieren. Der Kern des Systems liegt in der Kombination standardisierter Schnittstellen – als Tools bezeichnet – mit wiederverwendbaren Skills, die aus dem Wissen erfahrener Ingenieure destilliert wurden. Diese Skills ermöglichen es den Agenten, nicht nur Probleme zu diagnostizieren, sondern auch kontextbewusste Lösungen direkt anzuwenden. Die Agenten operieren dabei über mehrere Infrastrukturschichten hinweg: von Code und Konfiguration bis hin zu systemweiten Performance-Metriken. Sie können Profiling-Daten abfragen, Konfigurationen inspizieren und Optimierungen entweder empfehlen oder selbstständig implementieren.

- Meta setzt autonome KI-Agenten ein, um gebündeltes Ingenieurswissen zu skalieren und Leistungsprobleme in Server-Systemen selbstständig zu beheben.

- Anstatt wie beim klassischen Monitoring nur Warnmeldungen zu generieren, nehmen die intelligenten Agenten proaktive Systemoptimierungen direkt in Echtzeit vor.

- Diese tiefgreifende Automatisierung entlastet das Team enorm und sparte bereits hunderte Megawatt an Energie in Metas globaler Infrastruktur ein.

Vom Monitoring zum autonomen Handeln

Das ist der entscheidende Unterschied zu klassischen Monitoring-Tools: Statt nur Alerts zu generieren, handeln die Agenten. Der Shift geht von reaktivem Performance-Management hin zu kontinuierlicher, automatisierter Optimierung – Systeme werden in Echtzeit getuned, nicht erst nach einem Incident.

Eine zentrale Innovation ist die Art, wie Meta mit Engineering-Expertise umgeht. Statt darauf angewiesen zu sein, dass Senior-Ingenieure Probleme manuell diagnostizieren, kodiert das System deren Fachwissen in wiederverwendbare Agent-Skills. Das hat eine praktische Konsequenz: Best Practices werden konsistent über die gesamte Infrastruktur angewendet, unabhängig davon, wie komplex oder wie groß die Systeme wachsen. Meta demokratisiert damit den Zugang zu tiefem Engineering-Wissen – und skaliert menschliche Expertise, ohne die gleiche Anzahl von Menschen zu benötigen.

Das Ergebnis ist laut Meta eine massive Effizienzsteigerung: Durch die KI-Agenten konnten bereits hunderte Megawatt (MW) an Leistung in der globalen Flotte zurückgewonnen werden. Ingenieure können sich auf höherwertige Arbeit konzentrieren – neue Systeme designen, statt wiederkehrende Probleme zu debuggen.

Metas Initiative steht nicht allein. Google investiert parallel in KI-optimierte Infrastruktur, die Custom-Hardware wie die im April 2026 vorgestellten TPUs der achten Generation (TPU 8t für Training und TPU 8i für Inferenz) mit Softwaresystemen wie JAX kombiniert, um Workloads über massive Cluster dynamisch zu verteilen. Das Konzept des „AI Hypercomputer" – bei dem Performance-Optimierung durch eng verzahntes Hardware-Software-Co-Design erreicht wird – zeigt eine ähnliche Richtung, aber mit anderem Schwerpunkt. Amazon Web Services, Microsoft und spezialisierte Plattformen wie CAST AI fokussieren sich indes auf autonomes Ressourcen-Management und Kosteneffizienz, besonders für Kubernetes- und GPU-intensive Umgebungen.

Das Muster dahinter ist eindeutig: Ob durch Agenten, Custom-Silicon oder intelligente Orchestrierungsschichten – die Branche bewegt sich auf vollautomatisierte, selbst-optimierende Infrastruktur zu. Performance, Kosten und Effizienz werden künftig kontinuierlich in Echtzeit balanciert, nicht manuell getuned. Das setzt auch traditionelle Infrastrukturanbieter unter Druck, ihre Managed-Service-Konzepte grundlegend neu zu denken. Um den ROI von KI in der IT-Infrastruktur zu maximieren, setzen Unternehmen verstärkt auf AI Coding Assistants und autonome Agenten.

❓ Häufig gestellte Fragen

📰 Recherchiert auf Basis von 1 Primärquelle (infoq.com)

📚 Quellen