Anthropic hat mit einem vermeintlich kleinen A/B-Test seiner Preisstruktur eine fundamentale Diskussion über die Wirtschaftlichkeit moderner KI-Modelle ausgelöst. Der Versuch, die monatlichen Zugangskosten für den Programmierassistenten Claude Code für eine Testgruppe von Neukunden drastisch von 20 US-Dollar auf 100 US-Dollar zu erhöhen, provozierte nicht nur erheblichen Unmut innerhalb der Entwickler-Community. Der Vorfall rief auch OpenAI-CEO Sam Altman auf den Plan, der die temporäre Schwäche des direkten Konkurrenten für einen offenen strategischen Angriff auf Social Media nutzte.

- Anthropic löste mit einem kurzzeitigen Preistest, der die monatlichen Kosten für Claude Code um 400 Prozent anhob, heftige Marktreaktionen aus.

- OpenAI nutzte das Preis-Chaos umgehend für einen strategischen Angriff und positionierte seinen Assistenten Codex demonstrativ als preisstabile Alternative.

- Der Vorfall signalisiert das absehbare Ende günstiger KI-Flatrates und verdeutlicht Unternehmen die Dringlichkeit, herstellerunabhängige IT-Architekturen aufzubauen.

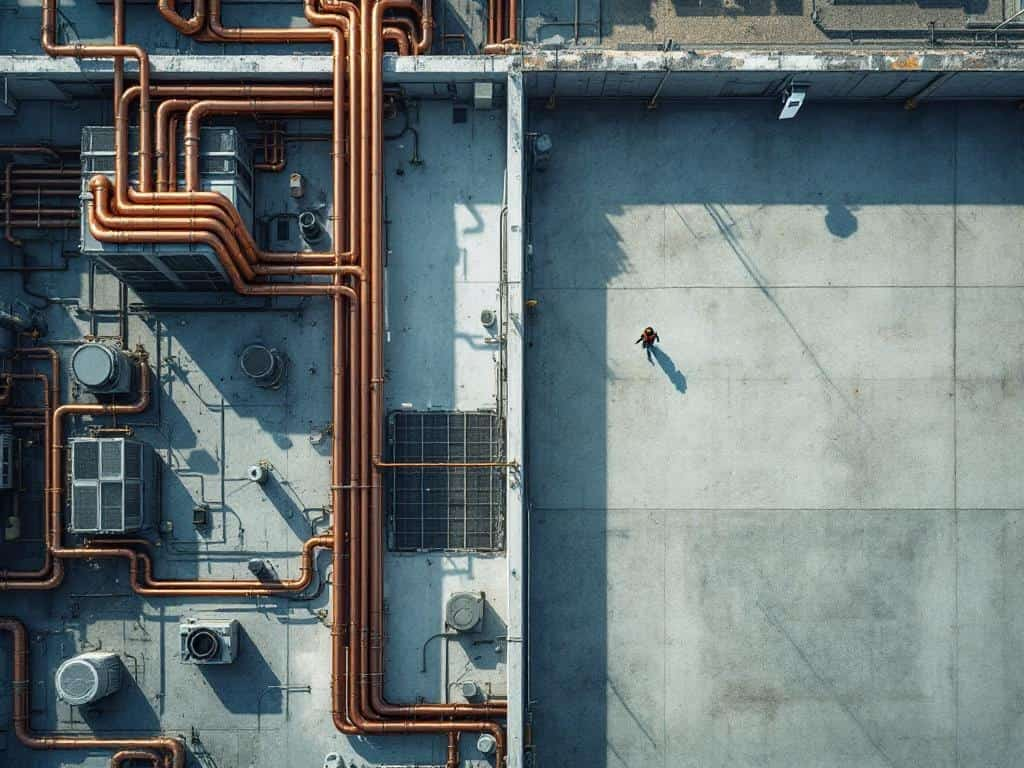

Dieser Vorgang offenbart eine kritische Marktdynamik, die weit über einen einfachen PR-Fehltritt hinausgeht. Die Entwickler hinter führenden KI-Modellen wie Claude Opus 4.7 oder den konkurrierenden GPT-5.4-Varianten operieren an den Grenzen ihrer Infrastruktur. Während sich autonome KI-Agenten zunehmend in der Softwareentwicklung etablieren, kollidieren die fixen Flatrate-Preismodelle der Anbieter massiv mit den explodierenden Kosten für die benötigte Rechenleistung. Für Technologie-Entscheider zeigt dieser Vorfall auf, dass die aktuelle Preislandschaft für generative Künstliche Intelligenz ein volatiles Konstrukt ist, das auf massiver Quersubventionierung basiert.

Die Margen-Falle der autonomen KI-Agenten

Die Ursache für Anthropics raschen Strategiewechsel liegt in der technischen Evolution der vergangenen zwölf Monate. Amol Avasare, Head of Growth bei Anthropic, benannte das Kernproblem öffentlich präzise: Als das Unternehmen im Jahr 2025 sein Max-Abonnement einführte, war dieses primär für textbasierte Chat-Nutzung konzipiert. Autonome KI-Agenten, die über Stunden hinweg eigenständig Code schreiben, testen und iterieren, existierten in dieser Form noch nicht in der breiten Masse der Nutzer.

Die Realität des Jahres 2026 sieht anders aus. Das Engagement pro Abonnent ist extrem gestiegen, was die Server-Ressourcen von Anthropic an ihre Belastungsgrenzen bringt. Seit dem 21. April 2026 musste der Anbieter nicht nur die allgemeinen Nutzungslimits für Pro- und Max-Abonnenten restriktiver handhaben, sondern verzeichnete auch größere Systemausfälle unter der massiven Last der Infrastruktur-Nachfrage. Der Preistest, der exakt zwei Prozent der neuen Prosumer-Anmeldungen betraf, war der Versuch, ein neues wirtschaftliches Gleichgewicht zu finden. Der Plan sah vor, Claude Code aus dem Basis-Abo für 20 US-Dollar (umgerechnet etwa 18,50 Euro) zu entfernen und in einer wesentlich teureren Stufe für 100 US-Dollar (ca. 93 Euro) im Monat zu platzieren. Nach einem massiven Rückschlag auf sozialen Netzwerken und anhaltender Verwirrung in der Nutzerbasis machte Anthropic den Test rückgängig und kehrte zur alten Preisdokumentation zurück.

OpenAIs opportunistischer Angriff auf den Rivalen

Die Nervosität im Markt zeigt sich deutlich an der ungewöhnlich aggressiven Reaktion von OpenAI. Sam Altman und weitere Führungskräfte nutzten das Preis-Chaos gezielt, um Anthropics Position als Entwickler-Liebling zu attackieren. Altman kommentierte die Erklärungsversuche von Anthropic auf der Plattform X am 22. April 2026 mit den Worten ok boomer

und schob provokant nach, dass er einen Drink genossen habe, als er die Marktreaktion beobachtete.

Hinter der lockeren Social-Media-Fassade verbirgt sich eine eiskalte Marktstrategie. OpenAI positioniert den eigenen Programmierassistenten Codex ganz bewusst als stabilen Gegenentwurf. Ein OpenAI-Mitarbeiter stellte öffentlich klar, dass Codex weiterhin in den kostenlosen sowie den Plus-Tarifen für 20 US-Dollar verfügbar bleiben wird. Die explizite Begründung lautete, OpenAI verfüge über die notwendige Rechenkapazität und ausreichend effiziente Modelle, um diese dauerhafte Auslastung zu tragen. Dieser rhetorische Schachzug zielt direkt auf das Vertrauen von Enterprise-Kunden ab. OpenAI signalisiert dem Markt: Während der Wettbewerber unter der Skalierung einbricht und Preise verfünffacht, garantiert OpenAI Infrastruktur-Sicherheit.

Der DACH-Markt zwischen Kostenkontrolle und Regulierung

Für den DACH-Raum kommt diese Volatilität zur Unzeit. Der Mittelstand steht bei der KI-Adoption weiterhin am Anfang. Analysten von Dr. Justus & Partners ermittelten im Januar 2026, dass 94 Prozent der deutschen Mittelstandsfirmen noch keinerlei KI-Lösungen implementiert haben. Gleichzeitig steigt der Nutzungsdruck in den Fachabteilungen: Das E3-Magazin (Januar 2026) berichtet, KI unterstütze bereits 25 Prozent der Aufgaben in deutschen Unternehmen, wobei eine Steigerung auf 41 Prozent in den nächsten zwei Jahren erwartet wird. Wenn Budgets für fundamentale Entwicklungstools spontan um 400 Prozent schwanken können, blockiert das Investitionsentscheidungen in ohnehin konservativen IT-Budgets.

Hinzu kommen strenge regulatorische Parameter. Wer seinen Entwickler-Stack auf Tools wie Claude Code oder Codex umstellt, muss diese Prozesse DSGVO-konform abbilden. Häufig greift hier Artikel 35 DSGVO (Datenschutz-Folgenabschätzung), da die Code-Generierung tief in geschäftskritische Prozesse eingreift. Auch der EU AI Act, dessen Hauptteil für Hochrisikosysteme im August 2026 in Kraft tritt, erzwingt bei der Nutzung von General Purpose AI (GPAI) klare Governance-Strukturen, besonders wenn es um Transparenz und Cybersecurity-Hygiene geht. Ein spontaner Wechsel des Anbieters, nur weil dieser seine Preise massiv anhebt, ist für einen europäischen Konzern administrativ enorm aufwendig und bindet kritische Compliance-Ressourcen.

So What? Das Ende der KI-Flatrate-Illusion

Die strategische Relevanz dieses kalkulierten Fehltritts von Anthropic ist enorm. C-Level-Entscheider müssen begreifen, dass die Phase des unbegrenzten Zugangs zu Large Language Models für 20 Euro im Monat logisch zu Ende gehen muss. KI-Modelle, die wie autonome Mitarbeiter fungieren, stundenlange Workflows abarbeiten und dabei kontinuierlich teure Token generieren, lassen sich nicht über B2C-Flatrates finanzieren. Die großen Anbieter haben den Markt über Monate hinweg massiv subventioniert, um Nutzergewohnheiten im Software Engineering zu verändern. Der Versuch von Anthropic, das Preismodell anzupassen, war ein ungeschickter, aber notwendiger Realitätscheck. Wer heute IT-Budgets für 2027 plant, sollte sich auf eine nutzungsbasierte Abrechnung (Pay-as-you-go) oder deutlich teurere Enterprise-Lizenzen für autonome Agenten einstellen. OpenAIs aktuelle Preisstabilität ist in diesem Kontext ein Instrument der Marktdurchdringung, kein philanthropisches Dauerversprechen.

Fazit: Risikostreuung als IT-Prämisse

Die rasanten Eskalation rund um das Claude Code Pricing beweist, wie gefährlich eine Monokultur in der KI-Infrastruktur ist. Unternehmen dürfen sich nicht von einzelnen Anbietern abhängig machen, da sich Geschäftsbedingungen und Infrastruktur-Kosten in diesem Reifegrad der Technologie noch quartalsweise radikal verschieben können. Die klare Handlungsempfehlung für Technologie-Verantwortliche lautet: Bauen Sie eine agnostische Architektur auf, die es erlaubt, zwischen Modellen von Anthropic, OpenAI oder Open-Source-Alternativen dynamisch zu wechseln. Nur durch eine strikte Entkopplung von proprietären Schnittstellen behalten Organisationen die Hebelwirkung, um auf künftige, unweigerliche Preiskorrekturen des Marktes reagieren zu können, ohne die eigene Entwicklungsgeschwindigkeit zu kompromittieren.

Token-Rechner wird geladen…

❓ Häufig gestellte Fragen

✍️ Editorial / Meinungsbeitrag — basiert auf Einordnung der Redaktion, nicht auf externen Primärquellen.

📚 Quellen