Die Satellitenbildanalyse verändert sich grundlegend durch die Verlagerung von KI-Modellen direkt in den Orbit. Durch diese On-Orbit-Verarbeitung findet die Datenanalyse dort statt, wo sie entsteht, was die bisherige Architektur der Raumfahrtbranche transformiert und massive Effizienzgewinne ermöglicht.

- KI-Systeme an Bord von Satelliten filtern unbrauchbare Aufnahmen direkt im All heraus und reduzieren so massiv die Übertragungslast zur Erde.

- Bei Naturkatastrophen priorisieren Algorithmen kritische Bilder, wodurch lebensrettende Analysen innerhalb von Minuten zur Verfügung stehen.

- Durch Federated Learning trainieren Satelliten ihre Modelle gemeinsam im Orbit, sodass sensible Rohdaten den Weltraum nicht verlassen müssen.

SkyServe: Echtzeit-Intelligenz statt Datenstau

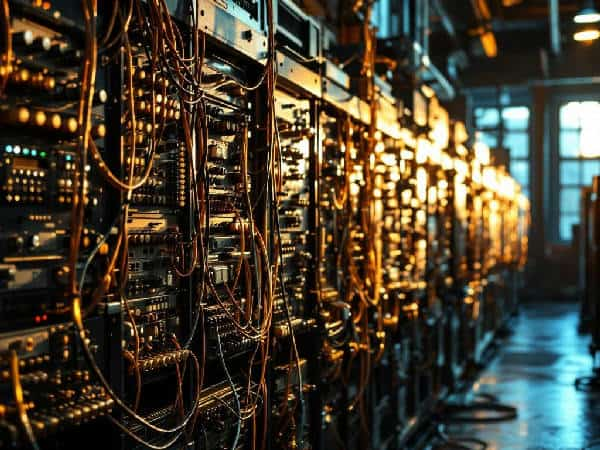

Das Hauptproblem der Satellitenbildauswertung war lange die schiere Menge an erzeugten Daten, die aufgrund begrenzter Übertragungskapazitäten nicht vollständig zur Erde gesendet werden konnten. Die Implementierung von Edge-Computing-fähigen KI-Modellen an Bord von Satelliten, wie es das Unternehmen SkyServe mit seiner STORM-Plattform praktiziert, löst diesen Engpass. Die On-Orbit-Verarbeitung ermöglicht es, Bildinhalte bereits im All zu klassifizieren und irrelevante oder wolkenbedeckte Aufnahmen herauszufiltern. Dies reduziert die Downlink-Last drastisch, während die Informationsdichte der übermittelten Daten steigt.

Die On-Orbit-Verarbeitung ist ein mehrschichtiger Prozess: Eine Onboard Cloud Segmentation identifiziert wolkenverdeckte Bildanteile, wodurch wertvolle Bandbreite gespart wird. Parallel dazu priorisiert eine KI-gestützte Datenpriorisierung die Übertragung basierend auf der Dringlichkeit der Inhalte. Dies ist besonders kritisch bei zeitgebundenen Ereignissen wie Naturkatastrophen, wo die Latenz zwischen Aufnahme und verwertbarer Information von mehreren Stunden auf wenige Minuten verkürzt wird. Laut UN-SPIDER ermöglicht Onboard-KI die Bereitstellung von Analysen unmittelbar nach der Erfassung, was die Reaktionszeit bei Waldbränden oder Überschwemmungen massiv verbessert.

Vor der Ära des Deep Learnings erforderte die Satellitenbildanalyse oft manuelle Auswertung, was zu erheblichen Verzögerungen führte. Moderne Convolutional Neural Networks und Vision Transformers automatisieren diesen Prozess heute und ermöglichen eine skalierbare Klassifizierung von Objekten wie Schiffen oder Gebäuden. Der nächste Schritt ist die Verlagerung dieser Rechenlast auf spezialisierte, strahlungsresistente Prozessoren. Das deutsche Unternehmen TerraLens bietet hierfür in Kooperation mit dem Deutschen Zentrum für Luft- und Raumfahrt (DLR) den RADIAN-Server an, der Radarbildverarbeitung durch GPU-Beschleunigung automatisiert und für den Einsatz in Bodenstationen sowie künftige orbitale Architekturen optimiert ist.

Eine weitere Innovation ist Federated Learning im Orbit. Hierbei trainieren KI-Modelle auf verschiedenen Satelliten gemeinsam, ohne dass Rohdaten die Systeme verlassen müssen. Dies gewährleistet Modellverbesserungen bei gleichzeitiger Wahrung des Datenschutzes und Berücksichtigung geopolitischer Sensibilitäten. Für Akteure im DACH-Raum, von Behörden bis zur Präzisionslandwirtschaft, bedeuten diese Fortschritte schnellere Analysen und reduzierte Infrastrukturkosten am Boden.

❓ Häufig gestellte Fragen

📰 Recherchiert auf Basis von 1 Primärquelle (spectrum.ieee.org)

📚 Quellen