Klassische Operations-Research-Teams brauchen Wochen, um ein komplexes Lieferkettenproblem in ein mathematisches Modell zu überführen – und wenn sich die Rahmenbedingungen ändern, beginnt der Prozess von vorne. NVIDIA adressiert genau diesen Engpass mit einem neuen Ansatz: cuOpt Agent Skills kombinieren die Reasoning-Fähigkeiten großer Sprachmodelle mit einer GPU-beschleunigten Optimierungs-Engine, sodass ein KI-Agent eine natürlichsprachige Anfrage wie „Erstelle einen 12-Wochen-Produktionsplan, der Gesamtkosten minimiert und die prognostizierte Nachfrage in allen Distributionszentren erfüllt" direkt in einen ausführbaren mathematischen Optimierungsjob übersetzt. Das Ergebnis ist ein umsetzbarer Plan inklusive Kosten, Kapazitätsauslastung und Constraint-Slack – in Sekunden statt Wochen. Der technische Blog von NVIDIA, veröffentlicht am 4. Mai 2026 von Adi Geva, Rajath Narasimha und Sylendran Arunagiri, beschreibt den vollständigen Workflow anhand eines Multi-Perioden-Planungsproblems und stellt das zugehörige Open-Source-Referenz-Workflow auf GitHub zur Verfügung. Was steckt technisch dahinter – und was bedeutet das konkret für Teams, die Supply-Chain-Prozesse automatisieren wollen?

- NVIDIA cuOpt Agent Skills übersetzen natürlichsprachige Lieferketten-Probleme direkt in logische und ausführbare mathematische Optimierungsaufgaben.

- Die Architektur kombiniert das Textverständnis moderner LLMs mit enormer GPU-Beschleunigung und liefert so produktive Einsatzpläne in Sekunden.

- Unternehmen senken so die Kosten pro einzelnem Planungszyklus drastisch von über 2.000 Euro auf unter 30 Euro bei gesteigerter Entscheidungsgeschwindigkeit.

Was cuOpt Agent Skills eigentlich sind – und warum das Konzept trägt

Im Zentrum stehen sogenannte Agent Skills: ein offenes Format, das Agenten mit spezialisiertem Wissen und definierten Workflows erweitert. Konkret sind das gut beschriebene Funktions-Signaturen, die ein LLM dynamisch aufrufen kann – ähnlich wie ein Entwickler eine Bibliotheksfunktion importiert und nutzt. Jede Skill kapselt eine spezifische Optimierungsfähigkeit, etwa Produktionsplanung, Bestandsmanagement oder Routenoptimierung, zusammen mit einem klar definierten Input- und Output-Schema.

Der Clou liegt in der Kombination zweier Stärken: Das LLM versteht das Geschäftsproblem in natürlicher Sprache, reichert es mit Kontext an und orchestriert den Workflow. Die eigentliche Rechenarbeit – das Lösen linearer Programme (LP), gemischt-ganzzahliger Programme (MIP) und Routing-Probleme – übernimmt NVIDIA cuOpt, eine GPU-beschleunigte Optimierungs-Engine, die laut NVIDIA diese Problemklassen deutlich schneller als CPU-basierte Solver löst. Das LLM muss nicht selbst rechnen – es muss nur wissen, wann und wie es die passende Skill aufruft und was es mit dem Ergebnis anfängt.

Dieser Architekturansatz ist konzeptionell nicht trivial, weil er die klassische Trennung zwischen Problemformulierung und Problemlösung aufhebt. Früher saß zwischen dem Geschäftsanwender mit seinem Problem und dem OR-Solver eine Brücke aus spezialisierten Menschenteams. Agent Skills ersetzen diese Brücke durch einen automatisierten Reasoning-Layer – mit allen Vor- und Nachteilen, die das mit sich bringt.

Für den Einsatz in Produktion ist das Open-Source-Charakter der Skills-Definition wichtig: Entwickler können eigene Skills erstellen, die an die Domänenlogik des eigenen Unternehmens angepasst sind, und sie in die Agenten-Architektur einbinden. Das macht das System erweiterbar und verhindert Lock-in auf einen vordefinierten Funktionsumfang.

So setzt du es um: Der 5-Schritte-Workflow im Detail

Der von NVIDIA beschriebene Referenz-Workflow ist in fünf klar abgegrenzte Schritte gegliedert. Hier der Ablauf inklusive konkreter Klick-Pfade und erwarteter Ergebnisse:

- Umgebung einrichten: Bereitstellen eines Systems mit NVIDIA GPU und Installation des NVIDIA Container Toolkit, das GPU-Zugriff innerhalb containerisierter Workloads ermöglicht. Alternativ: Deploy eines NVIDIA Brev Launchable für eine vorkonfigurierte GPU-Umgebung in der Cloud – CUDA, Docker und alle weiteren Abhängigkeiten sind bereits installiert. Anschließend das cuOpt Agent Package mit seinen Dependencies installieren. Erwartetes Ergebnis: eine reproduzierbare, containerisierte Deployment-Umgebung, die über Development, Staging und Production konsistent funktioniert.

- Agent initialisieren: Als Reasoning-Modell kommt MiniMax M2.5 zum Einsatz. Entweder über öffentlich gehostete Endpoints oder – für maximale Performance – lokal via NVIDIA NIM. Der Start der Applikation erfolgt per Docker Compose-Befehl, der sowohl das UI als auch Phoenix-Tracing auf ihren jeweiligen Ports hochfährt. Nach diesem Schritt ist der Agent einsatzbereit und die registrierten Skills sind für das LLM sichtbar und aufrufbar.

- Supply-Chain-Daten bereitstellen: Für ein Multi-Perioden-Planungsproblem benötigt der Agent typischerweise folgende Daten:

- Nachfrageprognosen nach Produkt, Region und Zeitperiode

- Produktionskapazitäten und Stückkosten je Standort

- Lagerhaltungskosten und Kapazitätsgrenzen

- Transportkosten und Vorlaufzeiten

- Geschäftsconstraints wie Service-Level-Agreements oder Mindestproduktionsmengen

- Agent Skills aufrufen: Über einen natürlichsprachigen Prompt – etwa „Erstelle einen 12-Wochen-Produktions- und Bestandsplan, der Gesamtkosten minimiert und die prognostizierte Nachfrage in allen Distributionszentren erfüllt" – startet der Workflow. Unter der Haube nutzt die Architektur LangChain Deep Agents, um eine Hierarchie von Sub-Agenten zu spawnen. Der orchestrierende Agent zerlegt das Ziel in Teilschritte und delegiert: ein Sub-Agent extrahiert und validiert Eingabedaten, ein weiterer formuliert das mathematische Modell, ein dritter ruft die cuOpt Skill auf. An die Skill übergibt der Agent ein strukturiertes Payload mit Entscheidungsvariablen, Zielfunktion und Constraints.

- Lösung abrufen und nutzen: cuOpt führt die Optimierung auf der GPU aus und nutzt dabei massive Parallelisierung, um den Lösungsraum schneller zu evaluieren als traditionelle CPU-Solver. Der Agent empfängt die optimierten Entscheidungsvariablen – wie viel von welchem Produkt in welcher Periode produziert werden soll, welche Bestände zu halten sind, wohin Waren verschickt werden – und übersetzt sie in eine lesbare Zusammenfassung mit Kennzahlen wie Gesamtkosten, Kapazitätsauslastung und Constraint-Slack. Das Ergebnis kann direkt in nachgelagerte Ausführungssysteme übertragen oder durch Follow-up-Prompts verfeinert werden.

Für den schnellen Einstieg ohne eigene GPU-Infrastruktur: Das Referenz-Workflow-Notebook ist auch über Google Colab zugänglich.

Prompt-Werkzeugkasten: Zwei copy-paste-fähige Starter-Prompts

Der Einstieg in cuOpt Agent Skills ist erfahrungsbasiert einfacher, wenn du mit getesteten Prompt-Strukturen beginnst. Hier zwei vollständige, direkt einsetzbare Beispiele – der erste für klassische Produktionsplanung, der zweite für Bestandsoptimierung:

ROLE: Du bist ein Supply-Chain-Optimierungsagent mit Zugriff auf cuOpt Agent Skills.

KONTEXT: Ein produzierendes Unternehmen mit 3 Werken und 8 Lagern in Deutschland, Österreich und der Schweiz.

AUFGABE: Erstelle einen 12-Wochen-Produktionsplan für 5 Produktgruppen, der die Gesamtproduktionskosten minimiert, alle prognostizierten Absatzmengen erfüllt und Produktionskapazitäten nicht überschreitet.

OUTPUT-FORMAT: Tabellarischer Produktionsplan pro Woche und Werk, Gesamtkosten, Kapazitätsauslastung je Standort, Hinweis auf bindende Constraints.Zeitersparnis: Manuell erstellt ein erfahrenes OR-Team einen solchen Plan in 2–3 Arbeitstagen. Mit dem Agent-Workflow reduziert sich das auf unter eine Stunde für Setup und Parameterisierung, die eigentliche Rechenzeit liegt im Minutenbereich. Spart ca. 10–15 Stunden pro Planungszyklus.

ROLE: Du bist ein Bestandsoptimierungs-Agent mit Zugriff auf cuOpt Inventory Skills.

KONTEXT: Ein Handelsunternehmen mit saisonaler Nachfrage, 130 Lagerpunkten und definierten Service-Level-Agreements (SLA: 98% Lieferfähigkeit).

AUFGABE: Berechne optimale Sicherheitsbestände und Bestellpunkte für 50 SKUs für das nächste Quartal. Minimiere Lagerhaltungskosten, halte SLA ein, berücksichtige Vorlaufzeiten und Mindestbestellmengen.

OUTPUT-FORMAT: SKU-Liste mit Sicherheitsbestand, Bestellpunkt, erwarteten Lagerhaltungskosten und Auslastung je Lagerpunkt. Markiere kritische SKUs mit Risiko-Score.Funktioniert dieser Workflow auch in der kostenlosen Variante? MiniMax M2.5 ist über öffentlich gehostete Endpoints nutzbar, aber für ernsthaften Produktionseinsatz empfiehlt NVIDIA die lokale NIM-Deployment-Variante. Ein vollständig kostenloser Einstieg ist über das Google-Colab-Notebook möglich, ohne eigene GPU. Wie lange dauert die Ersteinrichtung wirklich? Mit dem Brev Launchable sind Umgebung und erster Test-Run in unter 30 Minuten einsatzbereit. Eine eigene GPU-Infrastruktur mit Docker und NVIDIA Container Toolkit einzurichten, dauert erfahrungsgemäß 2–4 Stunden je nach Vorkenntnissen.

Was sich rechnet: ROI-Kalkulation für Supply-Chain-Teams

Wer über den Einsatz von cuOpt Agent Skills nachdenkt, braucht eine ehrliche Kosten-Nutzen-Einschätzung. Die folgende Rechnung basiert auf dem im Originaltext beschriebenen Multi-Perioden-Planungsuse-Case und typischen Marktpreisen:

Manueller Ansatz (Baseline): Ein erfahrener Operations-Research-Analyst kostet im DACH-Raum zwischen 80 und 120 Euro pro Stunde. Ein Planungszyklus für eine komplexe Multi-Perioden-Optimierung (12 Wochen, mehrere Standorte, 5+ Produktgruppen) dauert laut Branchenpraxis 2–5 Tage, inklusive Datenvorbereitung, Modellformulierung, Solver-Konfiguration und Ergebnisinterpretation. Bei 3 Arbeitstagen à 8 Stunden und 95 Euro Stundensatz: 2.280 Euro pro Planungslauf.

Agentic-AI-Ansatz: Setup-Aufwand: ca. 4 Stunden Entwicklerzeit (einmalig). Laufende Kosten pro Planungszyklus: API-Kosten für MiniMax M2.5 (einige Euro je nach Komplexität), GPU-Rechenzeit über Brev Launchable oder eigene Infra (ca. 15–30 Minuten Nutzung). Realistische Gesamtkosten pro Planungslauf nach Amortisation des Setups: unter 30 Euro. ROI bei monatlichen Planungszyklen über 6 Monate: Setup-Invest ca. 400 Euro, Einsparung ca. 2.250 Euro pro Monat → Break-even nach weniger als einer Woche.

Der eigentliche Wert liegt aber nicht allein in den direkten Kostenersparnissen: KI-Agenten können mehrere Szenarien parallel durchrechnen und auf veränderte Eingabedaten – etwa Nachfrageänderungen oder Kapazitätsausfälle – in Minuten reagieren. Was früher einen neuen Planungszyklus bedeutete, wird zur Follow-up-Anfrage im Chat. Das verändert die Entscheidungsgeschwindigkeit in Lieferketten fundamental.

Für DACH-Unternehmen, die noch keine KI implementiert haben – laut einer Analyse von Dr. Justus & Partners aus Januar 2026 sind das 94 Prozent des deutschen Mittelstands – ist cuOpt Agent Skills ein konkreter, klar abgrenzbarer Einstiegspunkt: kein diffuses KI-Transformationsprogramm, sondern ein messbarer Use Case mit nachvollziehbarer ROI-Logik.

Die typischen Fallstricke – und wie du sie umgehst

Wer cuOpt Agent Skills ohne Vorbereitung in Produktion bringt, trifft auf einige strukturelle Herausforderungen. Hier die drei häufigsten:

- Fallstrick 1: Datenvorbereitung wird unterschätzt. Der Workflow funktioniert nur so gut wie die bereitgestellten Daten. In der Praxis sind Nachfrageprognosen, Kapazitätsdaten und Transportkosten in verschiedenen Quellsystemen verteilt und oft inkonsistent formatiert. Lösung: Vor dem Agent-Deployment eine saubere Datenpipeline definieren, die Quelldaten in das von den Skills erwartete Schema transformiert. Der Referenz-Workflow nutzt bewusst Mock-Daten mit realer Struktur – diese Struktur als Template für die eigene Datenpipeline nutzen.

- Fallstrick 2: LLM-Halluzinationen bei Constraint-Formulierung. Ein LLM, das mathematische Constraints aus natürlicher Sprache ableitet, kann subtile Fehler machen – etwa eine „Mindestproduktionsmenge" als harte Untergrenze statt als weiche Präferenz interpretieren. Lösung: Immer ein Review-Gate einbauen, bei dem das formulierte mathematische Modell vor der Solver-Ausführung von einem Fachexperten geprüft wird. Phoenix Tracing, das im Workflow standardmäßig mitgeliefert wird, hilft dabei, die Reasoning-Schritte des Agenten nachvollziehbar zu machen.

- Fallstrick 3: EU AI Act und DSGVO-Implikationen bei personenbezogenen Daten. Sobald Lieferkettendaten Personalinformationen enthalten – etwa bei Außendienst-Disposition oder fahrerbezogener Routenoptimierung – greift Art. 22 DSGVO (automatisierte Entscheidungen mit wesentlichen Auswirkungen). Der EU AI Act stuft solche Systeme ab August 2026 potenziell als Hochrisiko-KI ein, wenn sie Entscheidungen über Arbeitsbedingungen automatisieren. Lösung: Schon beim System-Design klären, welche Entscheidungen vom Agenten empfohlen werden und welche zwingend einem Menschen zur Genehmigung vorgelegt werden müssen. Das „Human-in-the-Loop"-Muster, das NVIDIA in der erweiterten Architektur beschreibt, ist hier nicht nur Best Practice, sondern rechtlich geboten.

So What? Was dieser Ansatz für DACH-Entscheider bedeutet

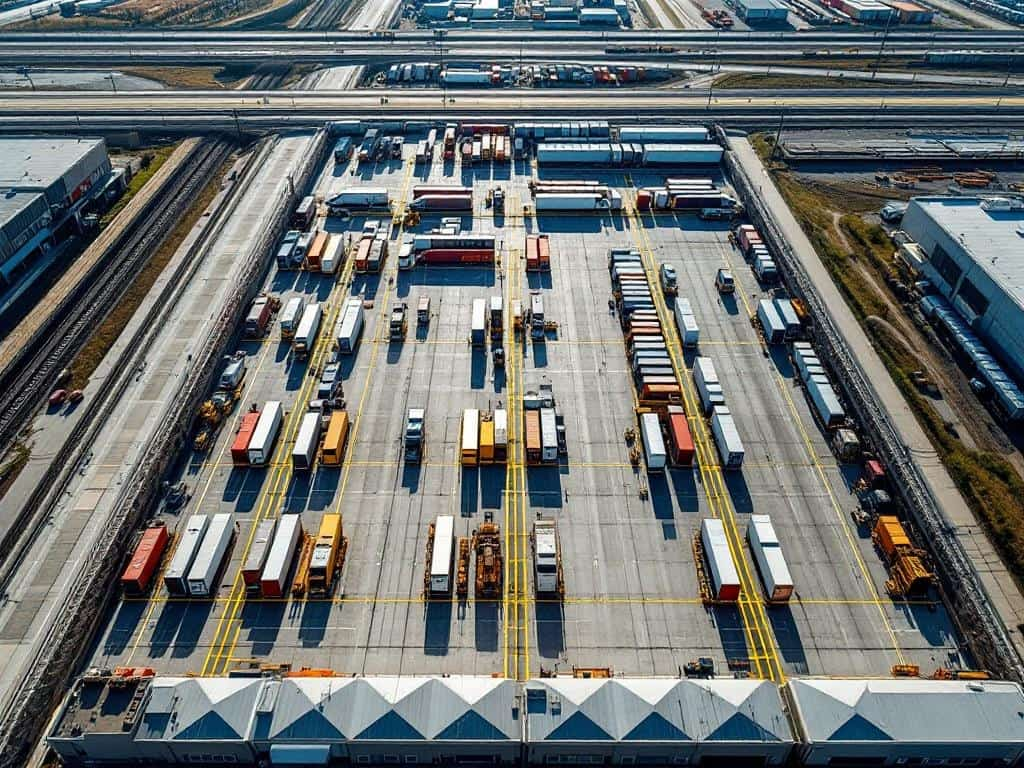

Das Timing dieses Releases ist kein Zufall: NVIDIA positioniert cuOpt Agent Skills als praxisreife Brücke zwischen dem Hype um Agentic AI und dem konkreten Bedarf in Logistik und Produktion. Die DACH-Industrie – mit ihren komplexen, exportorientierten Lieferketten – gehört zu den natürlichen Anwendern solcher Technologie. Siemens, Bosch, die deutschen Automobilzulieferer: Sie alle operieren Multi-Standort-Netzwerke mit genau den Problemstrukturen, für die cuOpt entwickelt wurde.

Was den Ansatz von bisherigen OR-Softwarelösungen unterscheidet, ist die Zugänglichkeit. Klassische Optimierungstools wie Gurobi oder CPLEX erfordern spezialisiertes mathematisches Know-how, um Probleme korrekt zu formulieren. cuOpt Agent Skills verlagern diese Formulierungsarbeit auf das LLM – was bedeutet, dass Supply-Chain-Manager ihre Anforderungen in Geschäftssprache statt in Modellierungssprache stellen können. Der Haken dabei: Das LLM muss das Problem trotzdem korrekt verstehen, und bei komplexen, mehrstufigen Constraints ist das keine Selbstverständlichkeit.

Für Teams, die heute mit Excel-Modellen oder manuellen Solver-Skripten arbeiten, ist der realistische Einstiegspfad klar: Referenz-Workflow auf GitHub klonen, mit eigenen Mock-Daten testen, Ergebnisqualität gegen manuelle Baseline vergleichen. Der Aufwand für diesen Proof-of-Concept liegt bei einem Arbeitstag für einen Entwickler mit Python-Kenntnissen. Wer danach ein klares „Diese Ergebnisse sind gut genug für unseren Use Case" formulieren kann, hat den schwersten Teil der Evaluierung bereits hinter sich.

Laut der E3-Magazin-Auswertung vom Januar 2026 unterstützt KI bereits 25 Prozent der Aufgaben in deutschen Unternehmen – mit Erwartung von 41 Prozent in zwei Jahren. Supply-Chain-Optimierung ist einer der Bereiche, in dem dieser Sprung am direktesten messbar ist: weniger Planungszeit, niedrigere Bestände, höhere Auslastung. cuOpt Agent Skills bieten dafür einen konkreten, technisch soliden Startpunkt.

Fazit: Solider Einstiegspunkt mit realen Anforderungen

NVIDIA cuOpt Agent Skills sind kein Konzeptpapier – sie sind ein deploymentfähiger Workflow mit Open-Source-Quellcode, Referenzdaten und einer klaren technischen Architektur. Die Kombination aus LLM-Reasoning und GPU-beschleunigtem Solver löst ein echtes Problem: den Bottleneck zwischen Geschäftsanforderung und mathematischer Optimierung. Wer einen OR-Analysten hat, der Wochen für einen Planungszyklus braucht, hat hier einen konkreten Hebel.

Gleichzeitig gilt: Die Technologie ist nicht trivial in der Umsetzung. Datenvorbereitung, Constraint-Validierung und die Frage, welche Entscheidungen wirklich vollautomatisch getroffen werden dürfen – das sind Fragen, die jedes Team für seinen Kontext beantworten muss. Der EU AI Act gibt ab August 2026 für Hochrisiko-Anwendungen verbindliche Antworten vor.

Meine klare Empfehlung: Startet mit dem GitHub-Referenz-Workflow und einem klar abgegrenzten, nicht-kritischen Use Case – etwa einem internen Produktionsplanungs-Pilot für einen einzigen Standort. Messt Ergebnisqualität und Zeitersparnis gegen eure Baseline. Wenn der Pilot überzeugt, habt ihr die Argumente für eine breitere Einführung bereits in der Hand. Wer wartet, bis die Technologie „fertig" ist, wartet in diesem Feld erfahrungsgemäß zu lange.

❓ Häufig gestellte Fragen

📰 Recherchiert auf Basis von 5 Primärquellen (github.com, nvidia.com, brev.nvidia.com, …)

📚 Quellen