Die These ist provokant, aber faktisch belegt: Für manche Teams übersteigen die Rechenkosten für KI-Agenten bereits die Ausgaben für menschliche Mitarbeiter — und Unternehmen werden von dieser Entwicklung kalt erwischt. Nicht weil KI-Agenten grundsätzlich teurer sind als Menschen, sondern weil der Einsatz ohne Kostenkontrolle, klare Aufgabengrenzen und Budget-Governance in eine Kostenfalle führt, die niemand modelliert hat. Bryan Catanzaro, Vice President of Applied Deep Learning bei Nvidia, hat das gegenüber Axios klar auf den Punkt gebracht: „For my team, the cost of compute is far beyond the costs of the employees." Das ist kein Randphänomen mehr — es ist ein strukturelles Problem, das aus der Mitte des Tech-Sektors heraus sichtbar wird und sich zunehmend auf alle Branchen ausweitet, die KI-gestütztes Coding oder Prozessautomatisierung skalieren wollen.

- Ohne strenge Kostenkontrolle und Budget-Governance übersteigen die Ausgaben für KI-Agenten in einigen Tech-Teams bereits die regulären Personalkosten.

- Das Phänomen "Tokenmaxxing" und der falsche Management-Druck zur intensiven KI-Nutzung belohnen ausufernden Token-Verbrauch statt echter Produktivität.

- Nur Unternehmen, die klare Aufgabentypen definieren und KI-Budgets strikt limitieren, erreichen mit der Technologie die versprochenen Einsparpotenziale.

Der Mechanismus dahinter ist einfach: KI-Agenten verbrauchen Tokens. Jede Anfrage, jede Aufgabe, jeder Hintergrundprozess — alles kostet. Wenn Entwickler mehrere Agenten parallel laufen lassen, ohne Oversight, läuft die Rechnung still mit. Und wenn Unternehmen von oben den Druck erhöhen, KI zu nutzen — wie Meta, das KI-Nutzungsmetriken bereits in Mitarbeiterbeurteilungen einbezieht — dann skaliert der Verbrauch schnell in Dimensionen, die keine Buchhaltung eingeplant hat. Das Ergebnis: Uber-Ingenieure haben durch Claude Code bereits das gesamte KI-Budget für 2026 aufgebraucht, wie The Information berichtete. Und das im April.

Tokenmaxxing: Wenn Token-Ausgaben zur Statussache werden

Es gibt einen Begriff für das Phänomen, dass Tech-Worker ihre Token-Ausgaben wie einen Wettbewerb betreiben: Tokenmaxxing. Laut einem Bericht der New York Times verbrauchen manche Power-User Millionen von Tokens an einem einzigen Tag und häufen monatliche Token-Rechnungen von über 150.000 US-Dollar an. Max Linder, ein Softwareingenieur aus Stockholm, hat das Verhältnis drastisch beschrieben: „I probably spend more than my salary on Claude." Das ist keine Ausnahme mehr — es ist ein Muster.

Das Tokenmaxxing-Phänomen entsteht nicht im Vakuum. Es ist das Ergebnis einer spezifischen Anreizkonstellation: Wenn KI-Nutzung als Produktivitätsindikator gewertet wird, steigt der Anreiz, möglichst viel zu nutzen — unabhängig davon, ob jeder Token einen tatsächlichen Wert produziert. Das ist das klassische Goodhart's Law in Aktion: Wenn eine Messgröße zum Ziel wird, hört sie auf, eine gute Messgröße zu sein. Unternehmen, die KI-Nutzung als Proxy für Engagement oder Leistung behandeln, züchten damit exakt das Verhalten, das ihre Kostenstruktur destabilisiert.

Hinzu kommt die kulturelle Dimension: In Tech-Circles ist hoher Token-Verbrauch inzwischen ein Statussymbol. Wer mehr Tokens verbraucht, arbeitet angeblich effizienter, delegiert mehr, skaliert aggressiver. Diese Logik ist gefährlich, weil sie die eigentliche Frage verdrängt: Erzeugt dieser Token-Verbrauch tatsächlich messbaren Output — oder produziert er vor allem Rechnungen?

Konkrete Zahlen illustrieren das Problem: Vygandas Pliasas, Geschäftsführer von Solidmatics, berichtet von rund 500 Dollar pro Woche bei einem „bewussten, von Menschen geführten Ansatz" für spezialisierte Programmieraufgaben. Investor Jason Calacanis schildert Fälle aus seinen eigenen Organisationen, in denen unkontrollierte Agenten über die Claude-API auf bis zu 300 Dollar pro Tag kamen — hochgerechnet rund 100.000 Dollar im Jahr. Das ist die Größenordnung eines vollwertigen Junior-Entwicklergehalts, ohne dass ein einziger Mitarbeiter eingestellt wurde.

Der Druck von oben: Wenn KI-Adoption zum Unternehmensimperativ wird

Das Kostenproblem wird durch einen Top-Down-Druck verschärft, der sich in der gesamten Branche beobachten lässt. „Pretty much 100 percent" von Anthropics Code wird laut Boris Cherny, dem Leiter von Claude Code, durch KI generiert. Google und Microsoft liegen nach eigenen Angaben bei etwa einem Viertel. Diese Zahlen werden nicht still kommuniziert — sie werden als Benchmark gesetzt, als Ausweis von Fortschrittlichkeit.

Wenn Führungskräfte solche Zahlen öffentlich kommunizieren, entsteht organisationaler Druck, nachzuziehen. Abteilungsleiter müssen rechtfertigen, warum ihr Team noch nicht bei 80 Prozent KI-generiertem Code ist. Die Folge: KI-Nutzung wird ausgeweitet, bevor die Kostenkontrolle steht. Nvidia-CEO Jensen Huang ist mit einem Vorschlag vorgeprescht, der die neue Realität illustriert: Er schlug vor, Softwareentwicklern KI-Tokens im Wert von etwa der Hälfte ihres Grundgehalts als Recruiting-Anreiz anzubieten. Tokens als Signing Bonus — ein Satz, der vor 18 Monaten noch absurd geklungen hätte.

Was dieser Vorschlag impliziert, ist bemerkenswert: Token-Budgets werden Teil der Vergütungslogik. Unternehmen müssen nicht mehr nur Gehälter, Sozialabgaben und Infrastrukturkosten kalkulieren — sie müssen auch die Rechenkosten modellieren, die ein Mitarbeiter durch seinen KI-Einsatz erzeugt. Das ist ein fundamentaler Wandel in der HR-Kostenstruktur, den die wenigsten Finanzabteilungen bislang abbilden. Greg Brockman von OpenAI empfiehlt bereits, das Token-Budget fest in Personalverhandlungen einzuplanen — ein weiteres Signal, dass KI-Rechenkosten zur regulären Betriebsausgabe werden, vergleichbar mit Reisekosten oder Softwarelizenzen.

Wettbewerb der Anbieter: Wer profitiert vom Token-Chaos?

Während Unternehmen an der Kostenkontrolle scheitern, beobachten KI-Anbieter die Entwicklung mit Interesse — und kalkulieren ihren Vorteil. Ein OpenAI-Investor äußerte gegenüber Axios, dass die Bedenken über Token-Kosten OpenAI zugutekommen könnten, da Codex Token effizienter nutze als Anthropics Claude Code. Das ist eine interessante Positionierung: Effizienz als Wettbewerbsargument, nicht Kapabilität.

Anthropic hat derweil die Preise für bestimmte Tiers erhöht — eine Entscheidung, die angesichts der hohen Nachfrage und der dokumentierten Abhängigkeit vieler Teams von Claude Code strategisch nachvollziehbar ist. Wenn Uber-Ingenieure schon im April ihr Jahresbudget aufgebraucht haben, ist das kein Anzeichen von Preissensitivität — es ist ein Anzeichen von Lock-in. Und Lock-in erlaubt Pricing Power.

Was dagegen spricht: Sind Token-Kosten wirklich das Problem?

Es gibt ein valides Gegenargument: Token-Kosten sind sichtbar und skalierbar. Personalkosten sind starr. Wenn ein KI-Agent in einer Stunde das schafft, wofür ein Entwickler einen Tag braucht, mag der Token-Verbrauch hoch sein — aber der relative Wert könnte trotzdem stimmen. Das ist die Grundlage, auf der Proponents des KI-Einsatzes argumentieren: nicht absolute Kosten vergleichen, sondern Output-pro-Dollar.

Das Argument hat Substanz — aber nur unter Bedingungen, die in der Praxis selten erfüllt sind. Erstens müssen die Outputs tatsächlich korrekt sein. Zweitens muss der menschliche Aufwand für Review, Debugging und Qualitätssicherung eingerechnet werden. Drittens müssen interne Zwischenfälle — wie sie bei Meta und Amazon dokumentiert sind, wo KI-Agenten ohne ausreichende Oversight Schäden angerichtet haben — als reale Kostenfaktoren erfasst werden, nicht als vernachlässigbare Ausnahmen.

Zahlreiche Studien deuten zudem darauf hin, dass die erzwungene Nutzung von KI-Tools die Arbeit für Angestellte tatsächlich erschweren kann. Wenn Produktivitätsdruck und mangelnde Qualitätskontrolle zusammentreffen, entsteht eine Kostenspirale, die in keiner ROI-Berechnung auftaucht: technische Schulden durch KI-generierten, unzureichend geprüften Code.

Bezeichnend ist auch, dass Investor Chamath Palihapitiya eine klare Faustregel formuliert hat: KI-Agenten müssen mindestens doppelt so produktiv sein wie menschliche Mitarbeiter, damit sie sich wirtschaftlich rechnen. Liegt die Produktivitätssteigerung darunter — etwa weil Reviews, Fehlerkorrekturen und Nachbesserungen den Effizienzgewinn auffressen — dann ist der Einsatz betriebswirtschaftlich nicht zu rechtfertigen, egal wie attraktiv die technologische Vision klingt.

Reale Einsparungen vs. unkontrollierte Eskalation: Was die Zahlen zeigen

Um das Bild vollständig zu machen, lohnt ein Blick auf Unternehmen, die KI-Agenten mit klaren Kostengrenzen einsetzen — und tatsächlich profitieren. Gut strukturierte KI-Agenten-Deployments erreichen Kosten zwischen 0,25 und 0,50 Dollar pro Interaktion, verglichen mit 3,00 bis 6,00 Dollar bei menschlichen Agenten. Das entspricht einer Einsparung von 85 bis 92 Prozent — aber nur dann, wenn die Aufgaben klar abgegrenzt, die Outputs überprüfbar und die Token-Budgets gedeckelt sind.

Telefónica etwa hat durch den Einsatz von KI-Agenten die Kosten pro Interaktion von 3,50 Euro auf 0,35 Euro gesenkt und dabei über 900.000 zusätzliche Sprachanrufe abgearbeitet. HelloFresh reduzierte seine jährlichen Support-Kosten von 12 Millionen auf 1,8 Millionen Dollar, indem 150 menschliche Agenten für Routineanfragen durch KI ersetzt wurden. Diese Zahlen zeigen: Das Problem ist nicht die Technologie — es ist das fehlende Management-Framework drumherum.

Der Unterschied zwischen diesen Erfolgsbeispielen und dem Uber-Fall liegt nicht in der Qualität des eingesetzten Modells. Er liegt darin, dass Telefónica und HelloFresh klare Aufgabentypen definierten, Nutzungsgrenzen setzten und die KI-Kosten als eigenen Budgetposten führten — bevor sie skalierten. Uber-Ingenieure dagegen hatten mit Claude Code freie Hand, ohne dass ein organisatorischer Rahmen existierte, der den Verbrauch hätte steuern können.

So What? Was das für DACH-Entscheider bedeutet

Für Entscheider in Deutschland, Österreich und der Schweiz ist die Lage spezifisch: Der Mittelstand hat laut einer Erhebung von Dr. Justus & Partners aus Januar 2026 KI-Ausgaben auf 0,35 Prozent der Umsätze reduziert — ein Zeichen, dass der Kostendruck bereits spürbar ist. Wer jetzt unkontrolliert KI-Agenten skaliert, läuft in exakt das Problem, das US-Tech-Unternehmen gerade öffentlich eingestehen müssen.

Konkret heißt das: Bevor du KI-Agenten in Produktionsprozesse bringst, brauchst du eine Token-Budget-Governance. Das bedeutet: Token-Verbrauch pro Aufgabentyp modellieren, monatliche Budgetobergrenzen pro Team definieren und Nutzungsmetriken nicht als Erfolgsindikator, sondern als Kostenfaktor behandeln. Jensen Huangs Idee, Token-Budgets als Teil der Vergütungsstruktur zu sehen, ist ein Hinweis, dass dieser Wandel kommt — aber er sollte nicht reaktiv, sondern proaktiv gestaltet werden.

Unter dem EU AI Act, dessen Hochrisiko-Regeln ab August 2026 gelten, kommt eine weitere Dimension hinzu: KI-Systeme, die in Personalentscheidungen einfließen — wie Metas Ansatz, KI-Nutzung in Mitarbeiterbeurteilungen einzubeziehen — können als Hochrisiko-Anwendungen eingestuft werden. Das bedeutet Dokumentationspflichten, Transparenzanforderungen und potenzielle Strafen bis zu 15 Millionen Euro oder drei Prozent des weltweiten Jahresumsatzes bei Verstößen. Wer KI-Nutzung als Leistungsmetrik einsetzt, sollte das rechtlich prüfen lassen, bevor er die Praxis skaliert.

Fazit: Token-Kosten sind ein Governance-Problem, kein KI-Problem

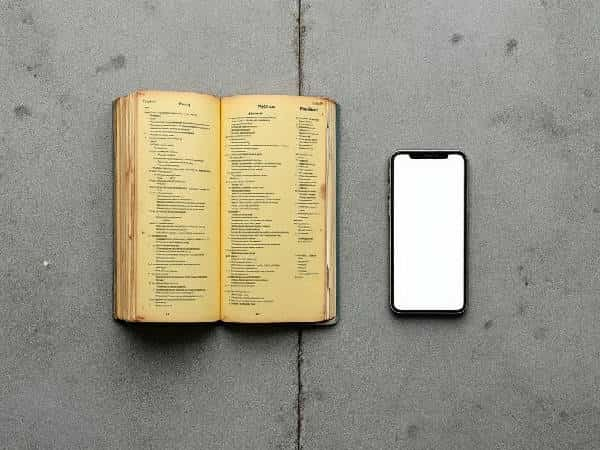

Das Kostenproblem bei KI-Agenten ist real — aber es ist kein Argument gegen KI-Agenten. Es ist ein Argument gegen den Einsatz ohne Governance. Die Unternehmen, die heute über explodierende Token-Rechnungen klagen, haben denselben Fehler gemacht wie Firmen, die Cloud-Infrastruktur ohne Kostenkontrolle hochgefahren haben: Sie haben Skalierung vor Steuerung gestellt.

Die Prognose: Wenn Unternehmen nicht innerhalb der nächsten zwölf Monate Token-Budget-Governance als Standard-Betriebsprozess etablieren, werden Token-Kosten zu einem regulären Budgetposten, der Personalentscheidungen verdrängt — nicht ergänzt. Wenn/Dann: Wer jetzt klare Kosten-Output-Modelle für KI-Agenten entwickelt, hat einen strukturellen Vorteil gegenüber Wettbewerbern, die reaktiv kürzen müssen. Der Vorteil liegt nicht im Tool — er liegt im Umgang damit.

❓ Häufig gestellte Fragen

📚 Quellen

- Axios: AI can cost more than human workers now (April 2026)

- The Information: Uber CTO Shows How Claude Code Can Blow Up AI Budgets (April 2026)

- CIO: Without controls, an AI agent can cost more than an employee (April 2026)

- New York Times: More! More! More! Tech Workers Max Out Their A.I. Use (März 2026)

- Eesel.ai: AI agent vs human agent cost: A practical 2026 comparison (März 2026)

✍️ Editorial / Meinungsbeitrag — basiert auf Einordnung der Redaktion, nicht auf externen Primärquellen.