Hugging Face hat eine Demo-Browser-Erweiterung veröffentlicht, die auf Transformers.js und Gemma 4 E2B basiert. Ziel ist es, Entwicklern den Einsatz lokaler KI-Funktionen in Chrome-Erweiterungen unter den Einschränkungen von Manifest V3 zu erleichtern.

- Hugging Face zeigt mit einer Demo-Erweiterung, wie lokale KI-Inferenz via Transformers.js unter den Restriktionen von Chrome Manifest V3 funktioniert.

- Ein Hintergrund-Service-Worker dient als zentraler Host für das Modell, wodurch Arbeitsspeicher gespart und die Benutzeroberfläche flüssig gehalten wird.

- Als effizientes und datenschutzfreundliches Herzstück kommt das 5,1-Milliarden-Parameter-Modell Gemma 4 E2B direkt auf dem Endgerät zum Einsatz.

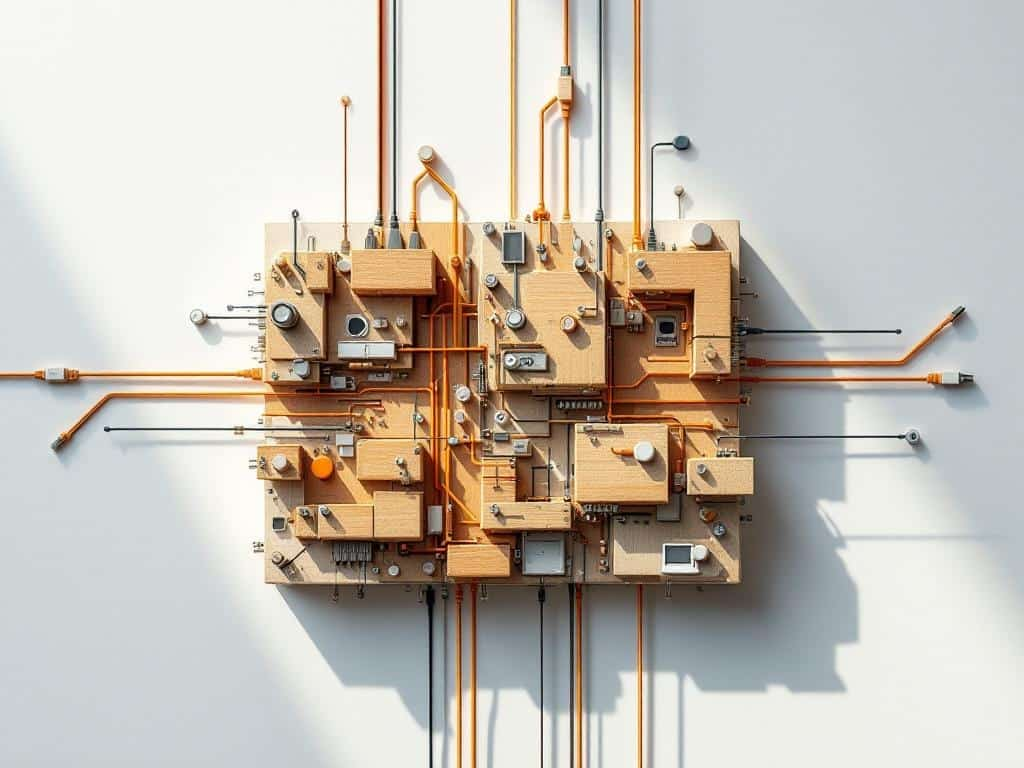

Die Erweiterung nutzt eine Architektur, die einen Hintergrund-Service-Worker für das Hosten von Modellen, eine Seitenleisten-Chat-Oberfläche und ein Inhaltsskript für seitenbezogene Aktionen umfasst. Diese Struktur adressiert gezielt die Herausforderungen von Manifest V3 hinsichtlich kurzlebiger Service-Worker-Laufzeiten und effizienter Nachrichtenübermittlung.

Zentrale Steuerung durch den Hintergrund-Service-Worker

Im Kern der Architektur steht der Hintergrund-Service-Worker (background.ts), der als zentrale Steuerungseinheit fungiert. Er verwaltet den Agenten-Lebenszyklus, die Modellinitialisierung und die Werkzeugausführung. Da Modelle im Service-Worker gehostet werden, profitieren alle Tabs von einem gemeinsamen Cache unter dem Extension-Origin (chrome-extension://), was den Speicherverbrauch massiv reduziert.

Effizientes Nachrichtensystem für maximale Reaktionszeit

Die Kommunikation zwischen den Komponenten erfolgt über ein asynchrones Nachrichtensystem. Befehle wie AGENT_GENERATE_TEXT werden von der Seitenleiste an den Hintergrund gesendet, der die Inferenz durchführt und Status-Updates in Echtzeit zurückmeldet. Dies stellt sicher, dass die Benutzeroberfläche auch bei komplexen Berechnungen flüssig bleibt.

Gemma 4 E2B: Lokale Intelligenz auf neuem Niveau

Für die Inferenz setzt die Erweiterung auf das am 2. April 2026 veröffentlichte Gemma 4 E2B von Google DeepMind. Das Modell verfügt über 5,1 Milliarden Parameter, nutzt jedoch eine Mixture-of-Experts (MoE) Architektur, wodurch die aktiven Rechenkosten lediglich einem 2-Milliarden-Parameter-Modell entsprechen. Ergänzt wird dies durch all-MiniLM-L6-v2-ONNX für performante Vektoreinbettungen.

Modell-Lebenszyklus und Caching-Strategien

Der Modelllebenszyklus ist explizit gestaltet: Funktionen zur Überprüfung des Cache-Status vermeiden unnötige Redownloads. Während der Initialisierung wird der Fortschritt direkt an die Benutzeroberfläche gemeldet. Da Manifest V3 Service-Worker jederzeit suspendieren kann, nutzt die Erweiterung eine DynamicCache Klasse, um den Zustand der KV-Caches konsistent zu halten.

So What?

Die Integration von Transformers.js und Gemma 4 zeigt: Lokale KI in Browser-Erweiterungen ist kein theoretisches Konzept mehr, sondern durch Manifest V3-optimierte Architekturen praxistauglich. Unternehmen können nun datenschutzkonforme KI-Tools direkt im Workflow der Mitarbeiter platzieren, ohne auf teure Server-Infrastrukturen angewiesen zu sein.

Fazit

Die Demo-Erweiterung von Hugging Face setzt einen neuen Standard für die Entwicklung von KI-Tools. Durch die strikte Trennung von Inferenz und UI sowie die Nutzung hocheffizienter Modelle wie Gemma 4 E2B wird lokale KI unter Manifest V3 performant und skalierbar.

Token-Rechner wird geladen…

❓ Häufig gestellte Fragen

✅ 12 Claims geprüft, davon 6 mehrfach verifiziert

📚 Quellen