Clampd, eine Softwarelösung zur Absicherung autonomer KI-Agenten, hat im Rahmen des Proof of Usefulness Hackathon von HackerNoon eine Bewertung von 47 Punkten erhalten. Das Projekt, das sich noch in einer frühen Entwicklungsphase befindet, konzentriert sich auf die Etablierung von „Guardrails“ für KI-Systeme, um potenzielle Schäden durch fehlgeleitete Agenten zu verhindern.

- Clampd fungiert als selbstgehostete Zwischenschicht, die schädliche Aktionen von KI-Agenten in unter 25 Millisekunden blockiert.

- Die lokal aufgesetzte Technologie schützt Entwickler und Unternehmen in Echtzeit vor Datenlecks sowie verheerenden Systemausfällen.

- Zukünftig soll sich das System als Standard-Sicherheitsschicht etablieren und wird aktuell mit Partnern in der Praxis getestet.

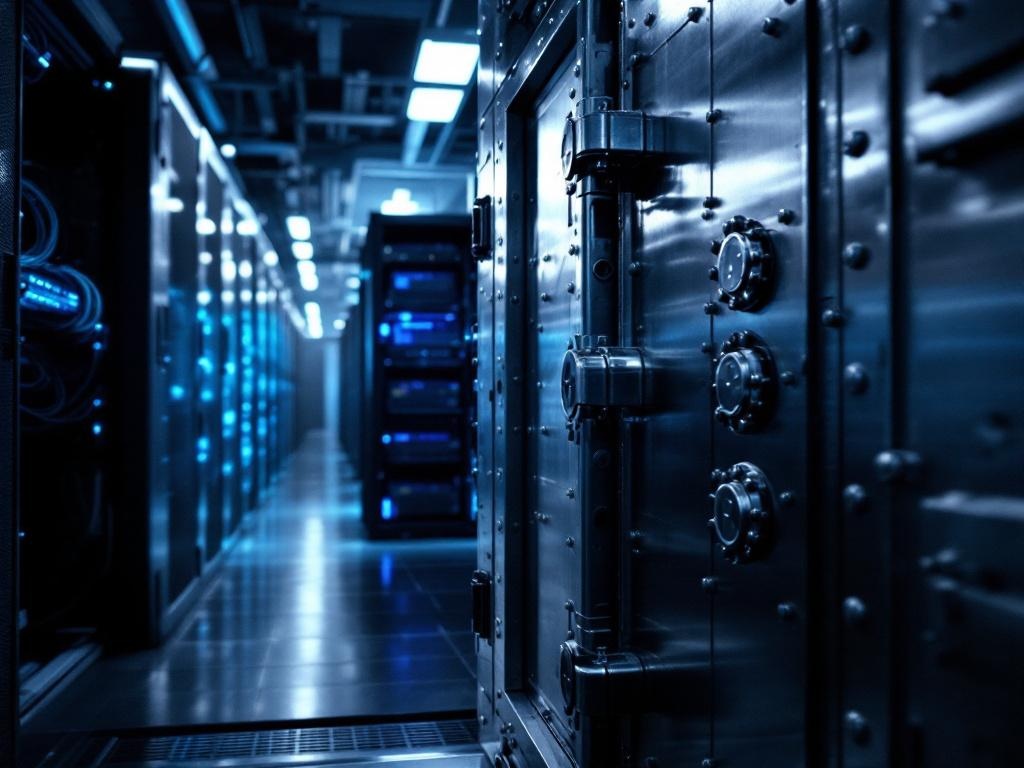

Das Kernprinzip von Clampd besteht darin, als selbstgehostete Zwischenschicht zwischen KI-Agenten und den von ihnen genutzten Tools zu agieren. Dies umfasst die Überwachung und Durchsetzung von Zugriffsbeschränkungen für Datenbankabfragen, API-Aufrufe, Dateizugriffe und Shell-Befehle. Laut Mehul Soni, der Clampd repräsentiert, kann die Software einen unerwünschten KI-Agenten innerhalb von 25 Millisekunden stoppen.

Die Notwendigkeit einer solchen Lösung wird mit der zunehmenden Autonomie von KI-Agenten begründet. Entwickler benötigen Mechanismen, um Datenlecks oder Systemausfälle zu vermeiden. Clampd richtet sich an Unternehmen, einzelne Entwickler sowie an Personen, die KI-Agenten wie Langchain, Anthropic, OpenAI oder CrewAI entwickeln und betreiben. Auch für Coding-Agenten und Agenten in CI/CD-Pipelines ist Clampd anwendbar.

Die Technologie hinter Clampd ist auf Geschwindigkeit und Sicherheit ausgelegt, um die geringe Reaktionszeit zu gewährleisten. Dabei bleibt die Architektur schlank und performanceorientiert, um eine vollständige Selbsthostung zu ermöglichen, bei der keine Daten das Netzwerk des Nutzers verlassen. Die Engine wurde in Rust entwickelt, um deterministische Entscheidungen ohne externe LLM-Aufrufe im schnellen Pfad zu ermöglichen.

Aktuell konzentriert sich das Team auf die grundlegende Entwicklung und die Verfeinerung der Sicherheitsmechanismen. Clampd sucht nach frühen Partnern, die KI-Agenten in realen Unternehmensumgebungen einsetzen, um die Software unter Praxisbedingungen zu testen. Der erreichte Proof of Usefulness Score von 47 spiegelt den aktuellen Entwicklungsstand wider, wobei zukünftige Punkte durch den Einsatz in der Praxis gewonnen werden sollen.

Das Potenzial von Clampd sieht Soni in drei Bereichen: latenzfreie Sicherheit, da die Durchsetzung unter 25 ms liegt; die Demokratisierung der Agenten-Laufzeitsicherheit, die bisher teure Unternehmenslösungen erforderte; und die Lösung des Paradoxons der Agentenautonomie, indem es die Nutzung mächtiger Agenten mit einem deterministischen „Kill Switch“ ermöglicht.

Als konkreten Nutzen führt Soni die Möglichkeit an, die Implementierung von KI-Agenten zu beschleunigen, da Entwickler weniger Angst vor unerwünschten Aktionen haben. Clampd kann beispielsweise das Löschen von Datenbanktabellen oder den Versuch der E-Mail-Exfiltration blockieren, während sichere Anfragen passieren. In Tests blockierte das System bereits Aktionen wie „DROP TABLE“ oder destruktive Shell-Befehle zuverlässig.

Die Messung des Nutzererfolgs erfolgt über die Häufigkeit von Richtlinienaktualisierungen, was auf eine aktive Integration des Proxys im lokalen Entwicklungszyklus hindeutet. Für die nächsten 12 Monate strebt Clampd eine stärkere Integration in das Ökosystem an, indem es sich als Standard-Laufzeit-Sicherheitsschicht für MCP-basierte Agenten-Deployments etabliert. Das Model Context Protocol (MCP) wird von großen Akteuren wie Anthropic, OpenAI und Google unterstützt.

Das Projekt sucht gezielt Partner, deren Agenten Zugriff auf Produktionsdaten, Datenbankänderungen, Kubernetes-Bereitstellungen oder Anmeldeinformationen haben. Diese „High-Stakes-Entwickler“ sind diejenigen, bei denen die Laufzeitsicherheit als unerlässlich angesehen wird. Die Strategie zur Skalierung sieht die Veröffentlichung von Open-Source-Richtlinienvorlagen für gängige Agentenarchitekturen vor, um die Sicherung von Agenten durch einfache Integration zu ermöglichen.

❓ Häufig gestellte Fragen

📰 Recherchiert auf Basis von 1 Primärquelle (hackernoon.com)

📚 Quellen