LoRA, kurz für Low-Rank Adaptation, etablierte sich schnell als bevorzugte Methode, um große Sprachmodelle (LLMs) effizient an spezifische Anwendungsfälle anzupassen. Die Attraktivität liegt in der deutlichen Reduktion der zu trainierenden Parameter, was Rechenressourcen spart und den Prozess beschleunigt. Unternehmen im DACH-Raum, die agile KI-Entwicklungszyklen anstreben, setzen LoRA vermehrt ein, um Modelle schnell zu personalisieren und auf ihre Daten abzustimmen. Doch die Praxis offenbart eine fundamentale Schwachstelle: LoRA geht stillschweigend davon aus, dass alle notwendigen Modellupdates von ähnlicher, niedrig-rangiger Natur sind. Diese Annahme trifft bei stilistischen Anpassungen, etwa dem Ändern des Tonals oder Formats, hervorragend zu, stößt aber an ihre Grenzen, sobald Modelle mit komplexem, faktischem Wissen angereichert werden sollen. Manager und technische Leiter stehen vor der Herausforderung, dass Modelle, die in der Theorie gut funktionieren, in der Produktion unzuverlässige oder ungenaue Antworten liefern, besonders wenn es um die Integration neuer, hochdimensionierter Fakten geht.

- Die effiziente Fine-Tuning-Methode LoRA stößt bei der Integration hochdimensionaler Fakten an ihre Grenzen, da sie komplexe Daten auf zu wenige Dimensionen reduziert.

- Dieser stille Informationsverlust zwingt Modelle in spezialisierten Bereichen wie Medizin oder Recht zu schwer erkennbaren, aber gefährlichen KI-Halluzinationen.

- RS-LoRA behebt diese fundamentale Schwäche durch eine verbesserte Skalierung, die das fehlerfreie Speichern komplexer Fakten mittels höherer Ränge stabil ermöglicht.

Die Konsequenzen dieser Diskrepanz reichen von subtilen Fehlinterpretationen bis hin zu manifesten Halluzinationen, welche die Verlässlichkeit von KI-Anwendungen untergraben können. Eine fehlerhafte Wissensintegration in spezialisierten Domänen wie Medizin oder Rechtswissenschaft kann weitreichende operative und finanzielle Folgen haben und das Vertrauen in KI-Systeme nachhaltig beschädigen. Die Notwendigkeit einer robusten Methode, die effizientes Fine-Tuning auch für komplexe Fakten ermöglicht, ist daher von entscheidender strategischer Bedeutung. Ohne eine solche Lösung bleibt die Skalierung von spezialisierten KI-Anwendungen ein kostspieliges und riskantes Unterfangen, welches die Innovationsgeschwindigkeit vieler Unternehmen im DACH-Raum hemmt.

LoRA: Die trügerische Annahme der Ähnlichkeit

Die Effizienz von LoRA beruht auf der Annahme, dass die erforderlichen Updates eines großen Modells auf eine kleine Anzahl von Dimensionen projiziert werden können. Bei der Low-Rank Adaptation werden die ursprünglichen Gewichtsmatrizen des Modells eingefroren. Statt diese direkt zu modifizieren, werden zwei kleinere, niedrig-rangige Matrizen A und B hinzugefügt, deren Produkt die eigentliche Aktualisierung ΔW darstellt. Diese Aktualisierung (ΔW = B·A) wird dann zum ursprünglichen Gewicht W addiert, um W‘ zu erhalten. Der Rang der Matrizen A und B (oft als r bezeichnet) ist dabei deutlich kleiner als die Dimension der ursprünglichen Gewichtsmatrix. Typischerweise liegt dieser Rang im Bereich von 4 bis 64, während die Originalmatrizen Tausende von Dimensionen umfassen können.

Die Kernidee ist, dass die meisten relevanten Änderungen an den Modellgewichten in einem niedrigeren dimensionalen Raum dargestellt werden können. Dies funktioniert hervorragend für Änderungen, die den Stil, den Tonfall oder die Persona eines Sprachmodells betreffen. Betrachte zum Beispiel die Anpassung eines Modells an einen lockeren, umgangssprachlichen Ton. Solche stilistischen Änderungen sind in der Regel kohärent und erfordern keine weitreichende Umstrukturierung des gesamten Wissensnetzes des Modells. Sie können oft durch gezielte, geringfügige Anpassungen in wenigen latenten Dimensionen erreicht werden. Ein LoRA mit einem Rang von 4 oder 8 kann solche Aufgaben effizient bewältigen.

Problematisch wird es jedoch, wenn neue, komplexe oder heterogene Fakten in das Modell integriert werden sollen. Hierbei geht LoRA stillschweigend davon aus, dass auch faktenbasiertes Wissen in einem niedrig-rangigen Raum abgebildet werden kann. Dies ist jedoch oft nicht der Fall. Factual Knowledge, insbesondere in spezialisierten Domänen wie Medizin oder Recht, zeichnet sich durch eine hohe Dimensionalität aus. Die Informationen sind nicht "homogen", sondern erfordern Modifikationen über ein breites Spektrum der Modellparameter. Bei geringem Rang (z. B. r=8) können diese Informationen nicht vollständig erfasst werden, was zu Halluzinationen führt.

Die Konsequenz der Diskrepanz: Halluzinationen und Vertrauensverlust

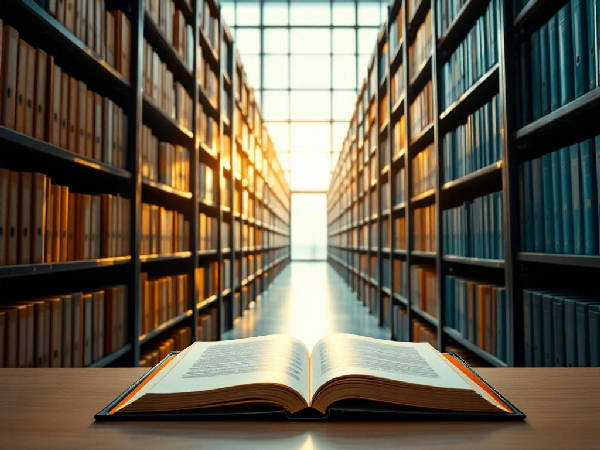

Die zentrale Annahme von LoRA führt zu einer fundamentalen Diskrepanz zwischen Theorie und Praxis. Im Kern bedeutet die Low-Rank-Approximation, dass bei der LoRA-Anpassung nicht alle Nuancen neuer Informationen vollständig abgebildet werden können. Stell dir vor, ein Buch wird auf eine kurze Zusammenfassung reduziert: Die Essenz mag erhalten bleiben, aber viele wichtige Details gehen verloren. Ähnlich verhält es sich, wenn LoRA versucht, hochdimensionale Fakten – wie detaillierte medizinische Befunde oder komplexe juristische Präzedenzfälle – in einen niedrig-rangigen Raum zu pressen.

Ein konkretes Beispiel hierfür liefert eine Studie, die zeigte, dass LoRA-trainierte Modelle im Kontext von juristischen Dokumenten zwar formal korrekte Sätze formulierten, jedoch wichtige rechtliche Nuancen ausließen (IBM Research, 2026). Ein weiteres Problem ergab sich in der Medizin: Bei der Anpassung an spezifische Leitlinien zur Medikamenteninteraktion scheiterte LoRA an seltenen, komplexen Wechselwirkungen, die eine breitere Informationsverteilung erfordert hätten. Das Modell "halluzinierte" hierbei nicht-existente Interaktionen (Resolve.ai, 2026).

Diese Halluzinationen sind besonders perfide, da sie oft nicht sofort erkennbar sind. Das Modell gibt "fließende" Antworten, die auf den ersten Blick richtig wirken. Laut einer Analyse von IBM treten bei der Zerlegung großer Gewichtsmatrizen in die kleineren LoRA-Matrizen unvermeidlich Informationsverluste auf (IBM Research, 2026). Die "stille" Natur dieser Fehler macht sie besonders gefährlich: Das System meldet keinen offensichtlichen Fehler, die ungenaue Repräsentation der Fakten führt jedoch zu schleichenden Qualitätsverlusten in der Ausgabe.

Limitationen und unerwartete Fallstricke in der LoRA-Implementierung

Neben den grundlegenden theoretischen Limitationen entfalten sich in der Praxis weitere Tücken. Ein signifikanter Fallstrick ist die "Low-Rank Bottleneck", wie sie in einem NeurIPS Paper von 2025 (AuroRA) beschrieben wird. Um die Leistungslücke zu vollständigem Fine-Tuning zu schließen, muss der Rang der LoRA-Matrizen oft deutlich erhöht werden. Doch für die Aufnahme von hochdimensionalen Informationen ist ein höherer Rang essenziell. Die Erhöhung des Rangs führt jedoch zu einem Anstieg der trainierbaren Parameter, wodurch der Effizienzvorteil teilweise obsolet wird.

Ein weiteres Problem ist der Präzisionsverlust bei der Verwendung von BF16 (Bfloat16) Floating-Point-Arithmetik. Wenn LoRA-Gewichte mit den ursprünglichen Modellgewichten zusammengeführt werden (W_merged = W + ΔW), können Rundungsfehler die subtilen Anpassungen der niedrig-rangigen Matrizen überlagern oder verfälschen. Dies ist besonders kritisch bei Modellen mit Milliarden von Parametern, bei denen die kumulativen Effekte dieser kleinen Fehler die Vorhersagegenauigkeit beeinträchtigen können. Unternehmen, die auf BF16 für ihre Trainings-Pipelines setzen, müssen sich dieses Risikos bewusst sein, da es die Stabilität der Wissensintegration direkt beeinflusst.

RS-LoRA: Stabile Skalierung für komplexe Wissens-Updates

Die Lösung für das Dilemma zwischen Effizienz und Faktenpräzision bietet Rank-Stabilized LoRA (RS-LoRA). Während das Standard-LoRA einen Skalierungsfaktor von α/r nutzt, setzt RS-LoRA auf α/√r. Diese mathematische Anpassung sorgt dafür, dass die Lernrate bei steigendem Rang (r) nicht unverhältnismäßig abnimmt. In der Praxis bedeutet dies, dass Entwickler den Rang massiv erhöhen können (z. B. auf r=256 oder r=512), um komplexe Fakten abzubilden, ohne dass das Modell instabil wird oder der Lernprozess stagniert.

RS-LoRA ermöglicht es somit, das "Low-Rank Bottleneck" zu umgehen, indem es die Kapazität des Adapters für hochdimensionale Daten öffnet. Für Unternehmen im DACH-Raum ist dies der entscheidende Hebel: Sie können die Effizienzvorteile von Adaptern beibehalten, aber gleichzeitig die für Fachanwendungen notwendige Faktenpräzision garantieren. Der Einsatz von RS-LoRA reduziert die oben beschriebenen Halluzinationen signifikant, da das Modell nun über genügend "Platz" in den Matrizen verfügt, um auch heterogene Datenstrukturen korrekt zu speichern.

So What?

Für Unternehmen und Entscheider bedeutet die Erkenntnis über LoRA-Limitationen: Bestehende Fine-Tuning-Strategien müssen evaluiert werden. Wer RS-LoRA implementiert, sichert sich eine stabilere Wissensbasis und reduziert das Risiko kostspieliger Halluzinationen in der Produktion. In einer Zeit, in der KI-Verlässlichkeit zum Wettbewerbsfaktor wird, ist der Wechsel von Standard-LoRA zu stabilisierten Methoden wie RS-LoRA oder AuroRA kein technisches Detail, sondern eine strategische Notwendigkeit.

Fazit

Die Entwicklungen rund um RS-LoRA zeigen: Die trügerische Annahme, dass alle Updates niedrig-rangig sind, wird durch moderne Forschung widerlegt. Wer jetzt strategisch handelt, höhere Ränge stabil nutzt und die konkreten Implikationen für das eigene Unternehmen prüft, verschafft sich einen messbaren Vorsprung in der Qualität seiner KI-Anwendungen.

❓ Häufig gestellte Fragen

📰 Recherchiert auf Basis von 4 Primärquellen (ibm.com, resolve.ai, neurips.cc, …)

📚 Quellen